經典神經網路學習(一)——AlexNet

阿新 • • 發佈:2018-12-21

AlexNet網路是AlexNet在2012年ImageNet大賽上一舉奪魁隨後一炮而紅,開啟了深度學習時代的網路。Alexnet一共包含8個層,其中5個卷積層,3個全連線層,用softMAx實現1000類分類。

AlexNet網路結構圖:

AlexNet網路模型特性:

- 使用ReLU非線性函式作為啟用函式,大大的加快了訓練時間,並且這使得ReLU流行起來

- 在池化層採用了重疊取樣的方法,有效的防止過擬合

-

引入新的Dropout方法,使Dropout的神經元不再進行前向傳播並且不參與反向傳播,減少網路訓練代價。結果在各個資料集的結果在翻譯中都有呈現

-

基於GPU跨GPU並行性好的特點,訓練方式採用多GPU訓練

AlexNet網路各個層的引數總圖(來自網易雲課堂吳恩達老師的課程截圖):

注:卷積核的厚度=被卷積的影象的通道數

卷積核的個數=卷積操作後輸出的通道數

輸入層:

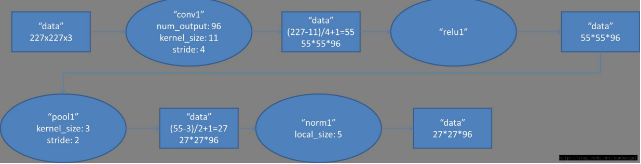

C1:使用96個的卷積核進行卷積核運算,卷積後生成

的畫素層,該卷積核為

,步長4。經過ReLU層後像素層維度不發生改變,然後經過一個池化層(卷積核為

,步長為2),得到

的畫素層。如下圖所示:

C2流程圖:

C3流程圖:

C4的流程圖:

C5流程圖:

fc6全連線流程圖:

fc7全連線流程圖:

fc8全連線流程圖: