論文解讀:Ask Your Neurons: A Neural-based Approach to Answering Questions about Images

阿新 • • 發佈:2018-12-09

這是關於VQA問題的第三篇系列文章,這篇文章是一篇比較經典的文章,所以跟大家分享。本篇文章將介紹論文:主要思想;模型方法;主要貢獻。有興趣可以檢視原文:Ask Your Neurons: A Neural-based Approach to Answering Questions about Images。

1,想法

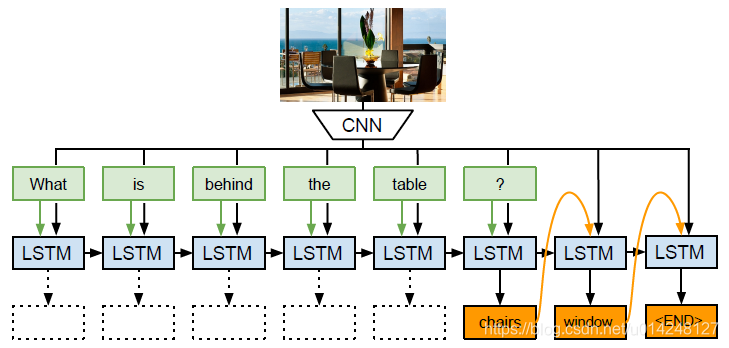

模型以CNN和LSTM為基礎,以一種新的使用方式,設計了一個預測結果長度可變的模型。該模型將視覺問答任務視為結合影象資訊作為輔助的sequence to sequence任務。

2,模型

模型:首先由一個預訓練好的深度CNN模型抽取出要回答的圖片特徵

a.影象特徵:

用一個訓練好的cnn提取影象特徵,然後把這個影象特徵送入每一個LSTM網路的輸入中。

b.文字特徵,以及LSTM網路的輸入

文字採用詞向量的輸入,即每個詞的詞向量。訓練時,文字特徵包括問題和答案:

測試時,文字特徵包括,問題和前一個詞的預測答案:

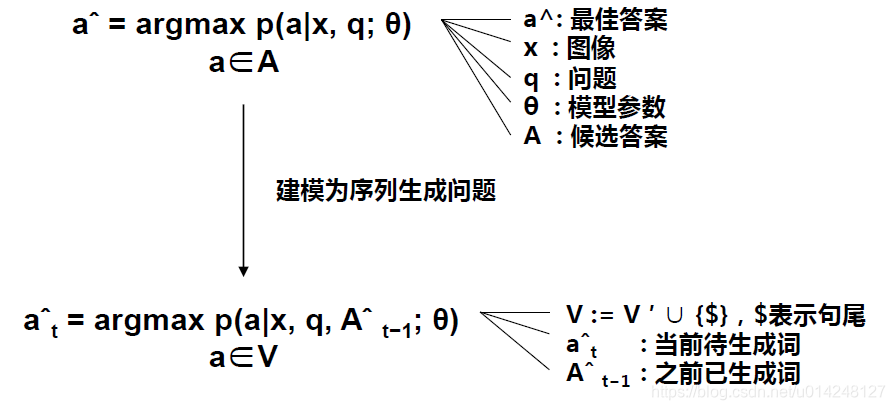

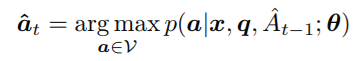

c.採用概率最大的方式預測答案

損失函式:只考慮了答案預測部分的損失函式,即問好前面的部分不考慮損失函式。

3.論文的貢獻

- 論文提出了seq2seq的方式,長生變長的的答案

- 論文提出了兩個新的評估指標,相親見原論文