【深度學習技術】LRN 區域性響應歸一化

阿新 • • 發佈:2019-02-18

LRN(Local Response Normalization) 區域性響應歸一化筆記

本筆記記錄學習 LRN(Local Response Normalization),若有錯誤,歡迎批評指正,學習交流。

1.側抑制(lateral inhibition)

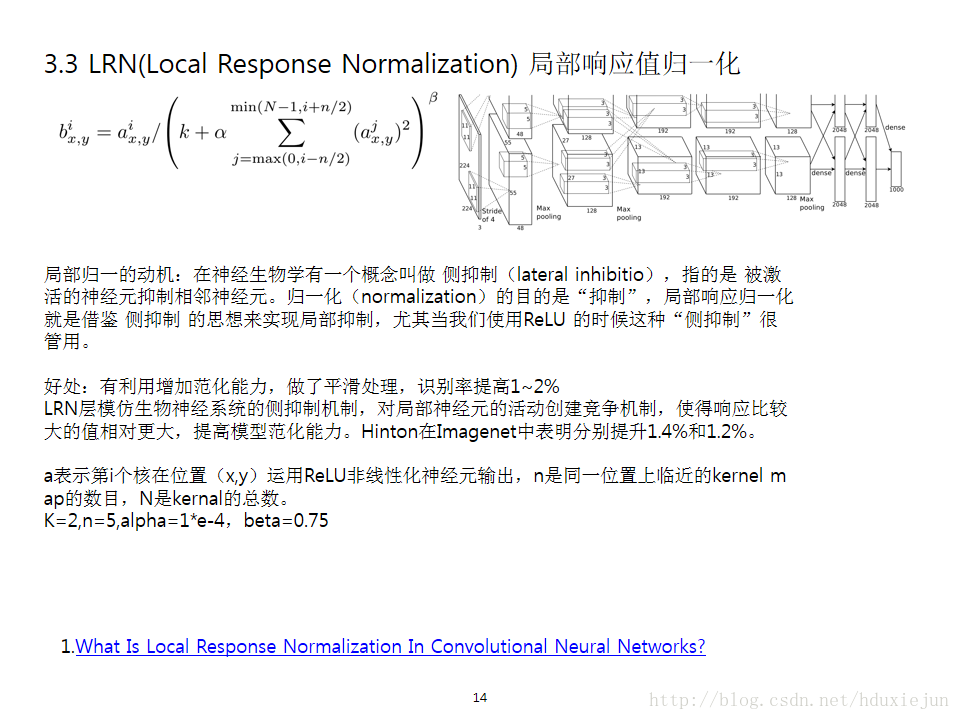

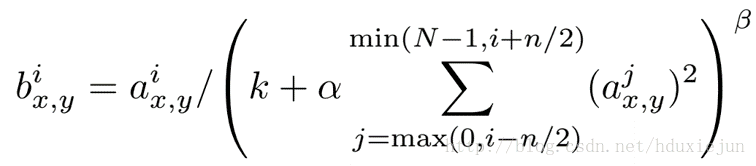

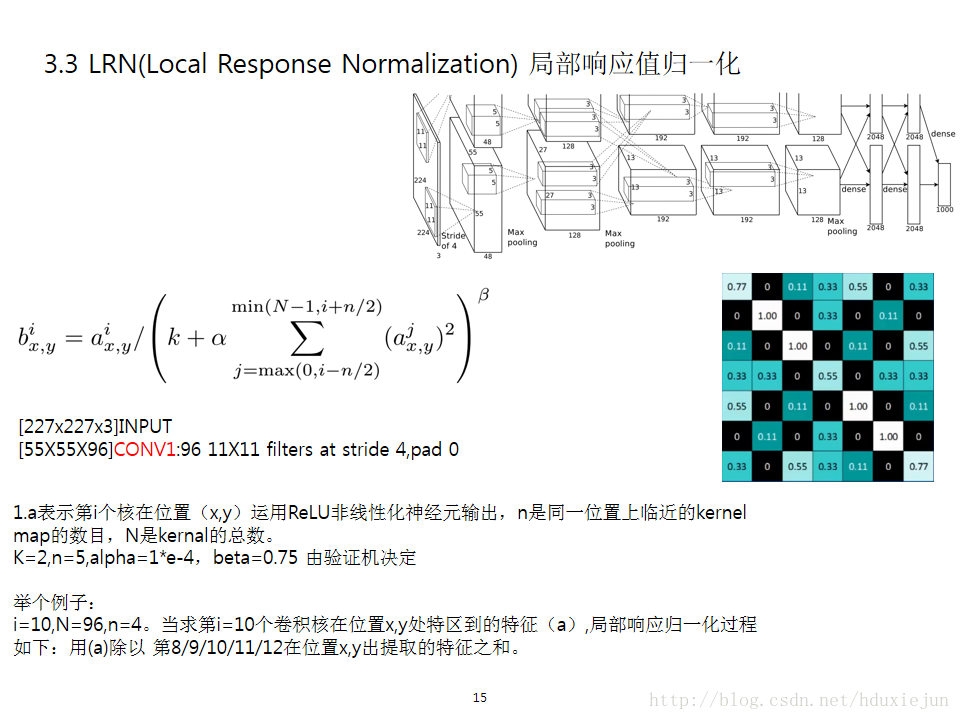

2.計算公式

Hinton在2012年的Alexnet網路中給出其具體的計算公式如下:

公式看上去比較複雜,但理解起來非常簡單。i表示第i個核在位置(x,y)運用啟用函式ReLU後的輸出,n是同一位置上臨近的kernal map的數目,N是kernal的總數。引數K,n,alpha,belta都是超引數,一般設定k=2,n=5,aloha=1*e-4,beta=0.75。

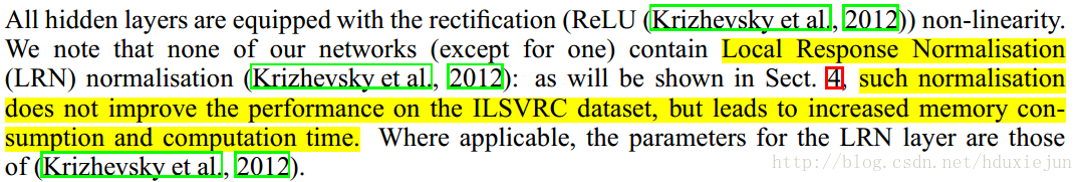

3.後期爭議

在2015年 Very Deep Convolutional Networks for Large-Scale Image Recognition.提到LRN基本沒什麼用。

在Alexnet模型中首次提出這個概念。

參考文獻:

[LRN]:ImageNet Classification with Deep Convolutional Neural Networks