二項分佈的對數似然函式與交叉熵(cross entropy)損失函式的聯絡

今天覆習Logistic迴歸的時候涉及到二項分佈的求最大似然解,突然發現這個對數似然函式熟悉,似曾相識,不就是交叉熵損失函式麼,難道這僅僅是巧合,不能夠。先看下這個推導。

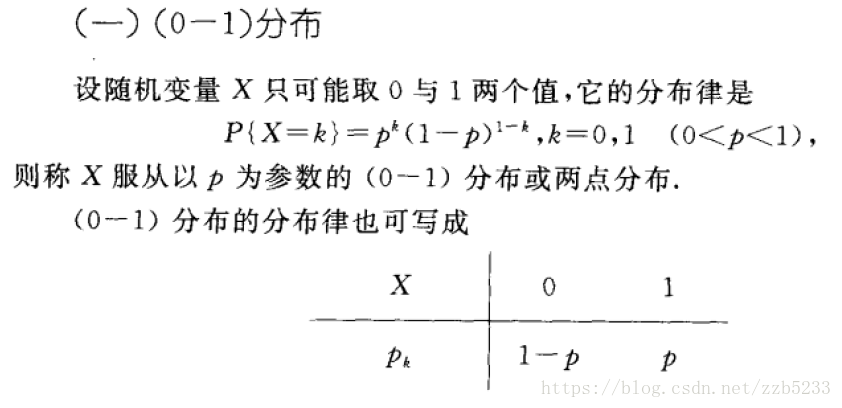

1. 二項分佈(0-1分佈):

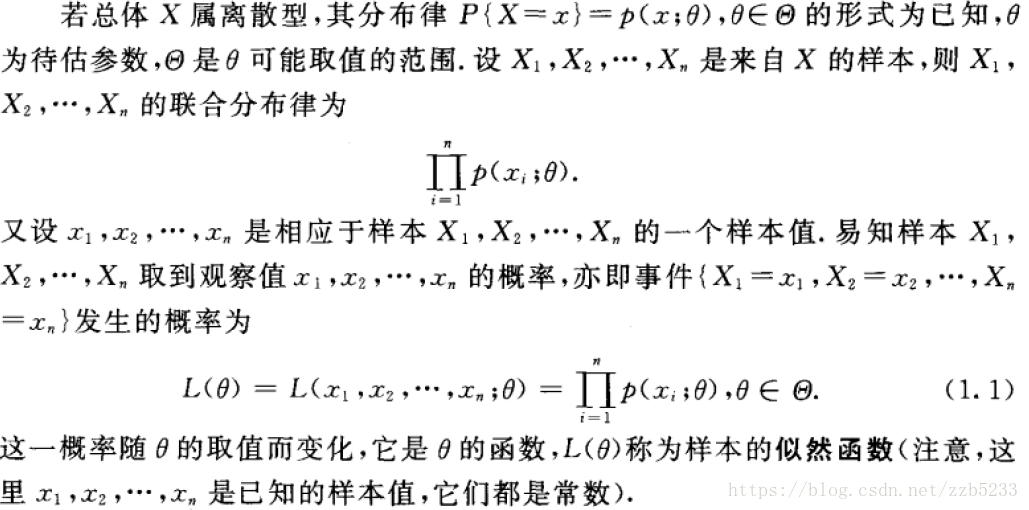

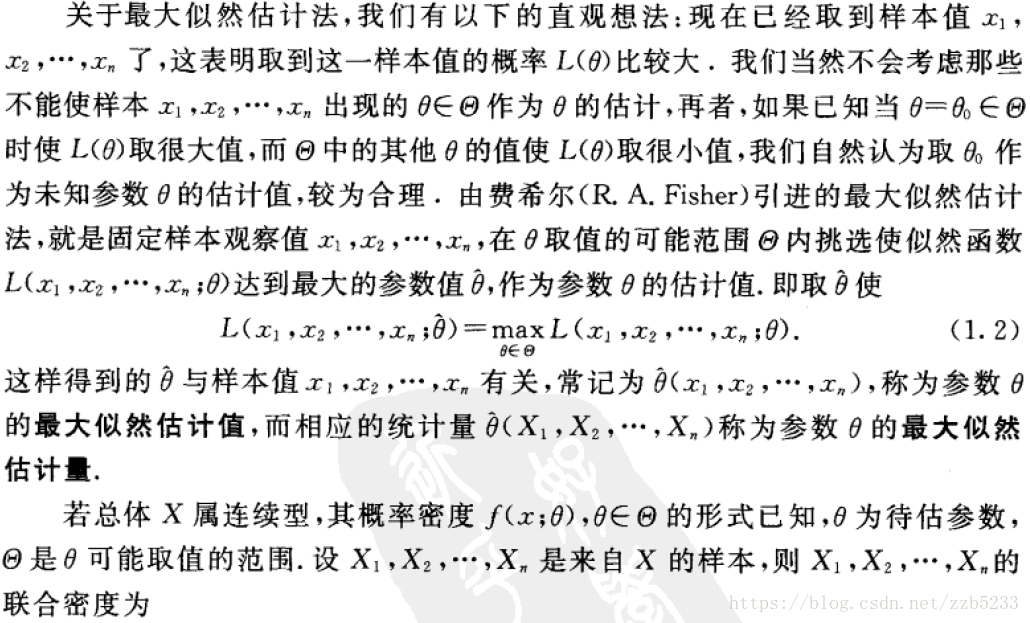

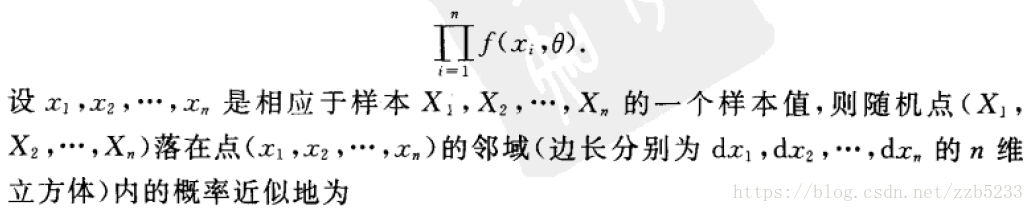

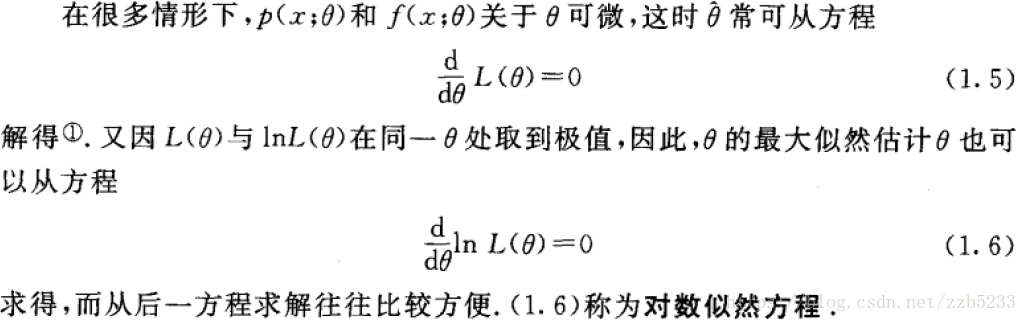

2. 最大似然估計法:

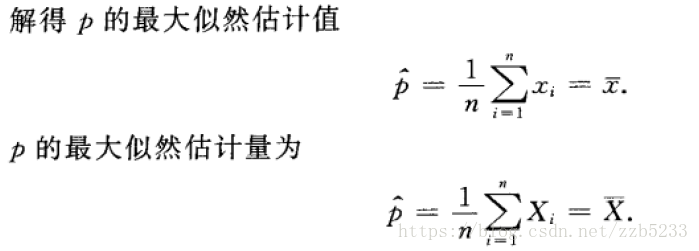

3. 求解最大似然估計量:

這裡我們主要看下標記處的對數似然函式,是不是很熟悉?

交叉熵代價函式(cross-entropy cost function)

參考:

概率論與數理統計 浙大版

相關推薦

【聯絡】二項分佈的對數似然函式與交叉熵(cross entropy)損失函式

1. 二項分佈 二項分佈也叫 0-1 分佈,如隨機變數 x 服從二項分佈,關於引數 μ(0≤μ≤1),其值取 1 和取 0 的概率如下: {p(x=1|μ)=μp(x=0|μ)=1−μ 則在 x

二項分佈的對數似然函式與交叉熵(cross entropy)損失函式的聯絡

今天覆習Logistic迴歸的時候涉及到二項分佈的求最大似然解,突然發現這個對數似然函式熟悉,似曾相識,不就是交叉熵損失函式麼,難道這僅僅是巧合,不能夠。先看下這個推導。 1. 二項分佈(0-1分佈): 2. 最大似然估計法: 3.

似然函式與最大似然估計、交叉熵概念與機器學習中的交叉熵函式

文章目錄 似然函式與最大似然估計 似然的概念 似然函式 最大似然估計 伯努利分佈 伯努利分佈下的最大似然估計 高斯分佈 高斯分佈下的最大似然估計 資訊量、熵、相對熵、交叉熵、機器學習中的交

深度學習基礎--loss與啟用函式--sigmiod與softmax;對數損失函式與交叉熵代價函式

sigmiod與softmax sigmiod就是邏輯迴歸(解決二分類問題);softmax是多分類問題的邏輯迴歸 雖然邏輯迴歸能夠用於分類,不過其本質還是線性迴歸。它僅線上性迴歸的基礎上,在特徵到結果的對映中加入了一層sigmoid函式(非線性)對映,即先把特徵線性求和,然後使

神經網路代價函式與交叉熵

在此我們以MSE作為代價函式:

深度學習裡的損失函式與交叉熵

1.MSE損失函式 損失函式是機器學習與深度學習裡面的重要概念。從名字上就可以看出,損失函式(Loss Function)反應的是模型對資料的擬合程度。一般來說,損失函式越小,說明模型對資料的擬合也越好。同時我們還希望當損失函式比較大的時候,對應的梯度也會比較大,這樣梯度下降的時候更

最大似然估計,交叉熵,相對熵(KL散度)

在機器學習中,選擇損失函式時,通常會遇到交叉熵的概念,也就是交叉熵損失函式,那麼我們知道最小化交叉熵損失函式等價於最大化對數似然,那麼最小化交叉熵損失函式其含義是怎麼樣本的?我們知道針對分類問題,我們並不知道Y的真實分佈,因此需要通過模型來估計Y的真實分佈,以邏

SQL Server 聚合函式與分組學習(group by)

一、SQLServer裡面的常用的五種聚合函式。 1.Sum(和)-—對於NULL值預設為0 2.MAX(最大值)MIN(最小值) 3.AVG (平均值)—不統計空值,例如存在有四個人,但是隻有三個人有成績,平均成績為:總和/3 4.COUNT(數量) --統計所有人分數總和

Softmax函式與交叉熵

Softmax函式 背景與定義 在Logistic regression二分類問題中,我們可以使用sigmoid函式將輸入Wx+b對映到(0,1)區間中,從而得到屬於某個類別的概率。將這個問題進行泛化,推廣到多分類問題中,我們可以使用softmax

模型評估和超引數調整(二)——交叉驗證 (cross validation)

讀《python machine learning》chapt 6 Learning Best Practices for Model Evaluation and Hyperparameter Tuning【主要內容】(1)獲得對模型評估的無偏估計(2)診斷機器學習演算法的

交叉驗證(Cross Validation)與網格搜尋(Grid Search)的原理及實證分析

1.交叉驗證背景在機器學習演算法中,當資料量不充分時,需要對資料進行重複使用,就出現了交叉驗證方法(Cross Validation),簡稱CV。交叉驗證顧名思義就是重複使用資料,把資料分為訓練集(Trading Set)、驗證集(Validation Set)、測試集(Te

度量學習(metric learning)損失函式

學習的物件通常是樣本特徵向量的距離,度量學習的目的是通過訓練和學習,減小或限制同類樣本之間的距離,同時增大不同類別樣本之間的距離。常用度量學習損失方法(1)對比損失用於訓練Siamese(孿生)網路,,輸入為兩張圖片,每一對訓練圖片都有一個標籤y,y=1表示兩張圖片屬於同一個

最大似然估計與最小二乘

現在 最小 bayesian 我不知道 什麽 改變 我不 tps 有關 參考: 最大似然估計,就是利用已知的樣本結果,反推最有可能(最大概率)導致這樣結果的參數值。例如:一個麻袋裏有白球與黑球,但是我不知道它們之間的比例,那我就有放回的抽取10次,結果我發現我抽到了8次黑球

伯努利分佈、二項分佈、Beta分佈、多項分佈和Dirichlet分佈與他們之間的關係,以及在LDA中的應用

在看LDA的時候,遇到的數學公式分佈有些多,因此在這裡總結一下思路。 一、伯努利試驗、伯努利過程與伯努利分佈 先說一下什麼是伯努利試驗: 維基百科伯努利試驗中: 伯努利試驗(Bernoulli trial)是隻有兩種可能結果的單次隨機試驗。 即:對於一個隨機變數而言,P(X

似然函式和最大似然估計與機器學習中的交叉熵函式之間的關係

關於似然函式和最大似然估計的詳細說明可以看這篇文章:https://blog.csdn.net/zgcr654321/article/details/83382729 二分類情況和多分類情況下的似然函式與最大似然估計: 二分類情況下的似然函式與最大似然估計: 我們知道按照生活中的常識

二項分佈與泊松分佈

二項分佈(Binomial distribution) 要介紹二項分佈,先要介紹伯努利實驗,然後自然而然就想到了拋硬幣問題,正面朝上的概率為p,反面朝上的概率為q (q = 1 - p),假設正面朝上標記為1,反面朝上為0,則一次伯努利實驗的期望為p,方差為p*q。 二項分佈是對n次

【機器學習】先驗概率、似然函式、後驗概率、對數似然函式等概念的理解

1)先驗:統計歷史上的經驗而知當下發生的概率; 2)後驗:當下由因及果的概率; 2、網上有個例子說的透徹: 1)先驗——根據若干年的統計(經驗)或者氣候(常識),某地方下雨的概率; 2)似然——看到了某種結果,對產生結果的原因作出假設:是颳風了?還是有烏雲?還是

先驗分佈,後驗分佈,似然函式

一個例子搞清楚(先驗分佈/後驗分佈/似然估計) preface: 無論是《通訊原理》、《資訊理論》、《通道編碼》還是《概率與統計理論》,或者在現在流行的《模式識別》和《Machine Learning》中總會遇到這麼幾個概念:先驗分佈/後

二項分佈、指數分佈與泊松分佈的關係

1、泊松分佈 由法國數學家西莫恩·德尼·泊松(Siméon-Denis Poisson)在1838年時發表; 若X服從引數為的泊松分佈,記為X~P(), 泊松分佈的概率分佈函式: 引數λ是單位時間(或單位面積)內隨機事件的平均發生率。 統計學上,滿足三個條件,即可用泊松分佈

二項分佈與泊松分佈學習[轉載]

轉自:https://blog.csdn.net/ccnt_2012/article/details/81114920 https://wenku.baidu.com/view/570c4d387375a417866f8f55.html https://wenku.baidu.com/view/eb143