java爬蟲 爬取網頁資訊

阿新 • • 發佈:2019-01-11

今天接觸到一個專案中非要讓我用爬蟲來爬取一個學校網頁的新聞頁面加子頁面所有文字資訊,畢竟需求就是上帝,然後查詢了一會之後發現並不難就是匹配字元、標籤是有些麻煩

好了直接上pom.xml

<dependency> <groupId>org.apache.httpcomponents</groupId> <artifactId>httpclient</artifactId> <version>4.5.5</version> </dependency> <!-- https://mvnrepository.com/artifact/org.jsoup/jsoup --> <dependency> <groupId>org.jsoup</groupId> <artifactId>jsoup</artifactId> <version>1.11.3</version> </dependency>

還有一個logger的log檔案我感覺沒用就直接給刪掉了

工具類

package com.bing.util; import org.jsoup.Jsoup; import org.jsoup.nodes.Document; import org.jsoup.nodes.Element; import org.jsoup.select.Elements; import java.io.IOException; public class joUtil { public static void main(String[] args){ try { Document doc = Jsoup.connect("http://soft.zut.edu.cn/") .timeout(60000).get(); doc.html(); Element tagElement = doc.getElementsByClass("news").first(); // String[] str = new String[10]; // String[] href = new String[10]; for(int i=0;i<tagElement.getElementsByTag("li").size();i++){ System.out.println(tagElement.getElementsByTag("li").get(i)); System.out.println(tagElement.getElementsByTag("a").get(i).attr("href")); System.out.println("http://soft.zut.edu.cn/"+tagElement.getElementsByTag("a").get(i).attr("href")); Document doc2 = Jsoup.connect("http://soft.zut.edu.cn/"+tagElement.getElementsByTag("a").get(i).attr("href")) .timeout(60000).get(); doc2.html(); Elements tagElement2 = doc2.getElementsByClass("v_news_content"); Elements tagTitle = doc2.getElementsByClass("titlestyle67237"); System.out.println("子頁面爬取開始---->"); System.out.println("標題"); System.out.println(tagTitle.text()); System.out.println("正文"); System.out.println(tagElement2.text()); System.out.println("子頁面爬取結束--->"); // str[i] = tagElement.getElementsByTag("li").get(i).text(); // System.out.println("第幾次爬取?"); // System.out.println(i); } // for (String s : str) { // System.out.println(s); // } } catch (IOException e) { e.printStackTrace(); } } }

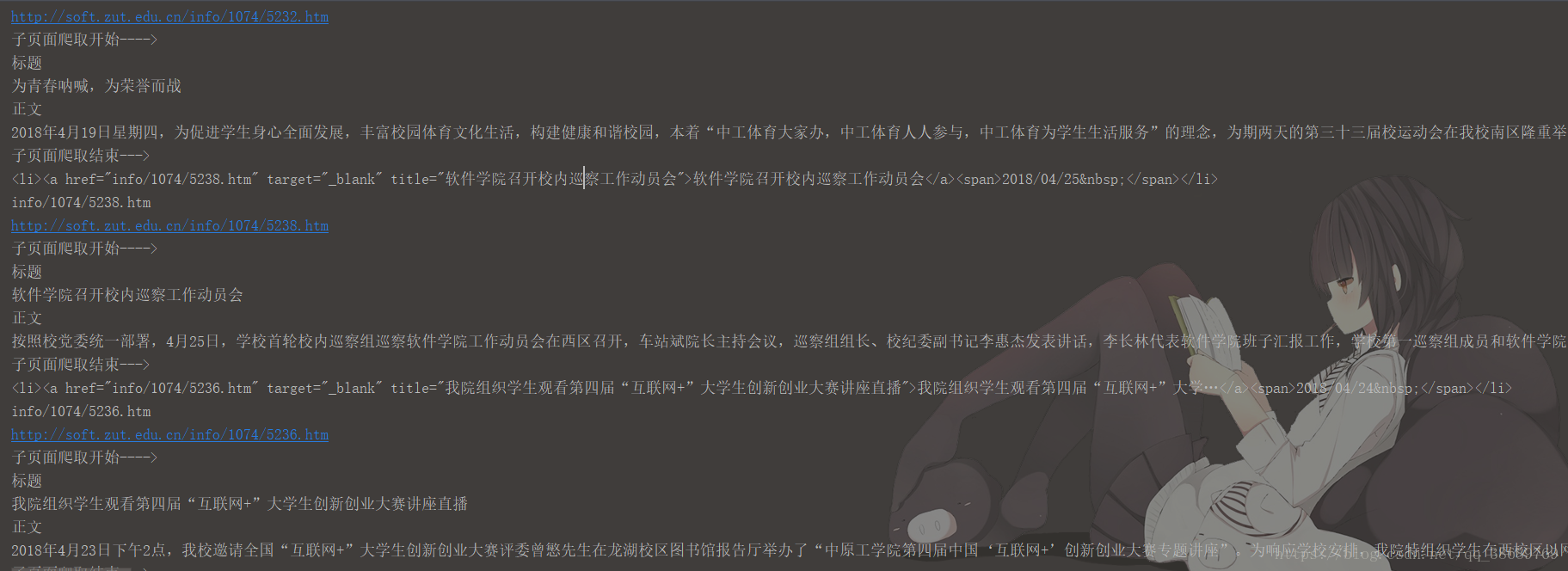

最後執行

這是一個學校官網的頁面爬取 再進行子頁面的新聞資訊爬取 直接通過Document的元素操作進行的 畢竟第一次接觸還算不錯想要的資訊都爬取出來了 大家有更好的方法歡迎艾特我 謝謝