牛頓法求解最小二乘問題(線性迴歸)

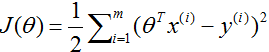

用牛頓法求解代價函式

的最小值,這裡

的最小值,這裡 是n維向量,

是n維向量, 是實數。

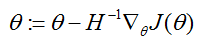

是實數。解 牛頓法(詳細點此)迭代公式為

,

,這裡,

是

是 關於

關於 的偏導數向量;

的偏導數向量; 是一個n

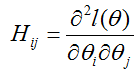

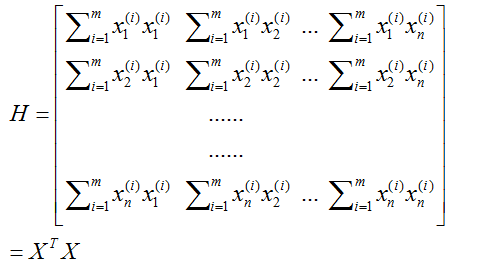

x n被稱作Hessian的矩陣,其元素為

是一個n

x n被稱作Hessian的矩陣,其元素為 。

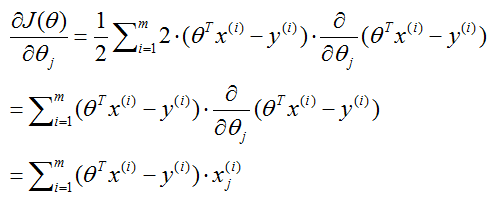

。先求

關於

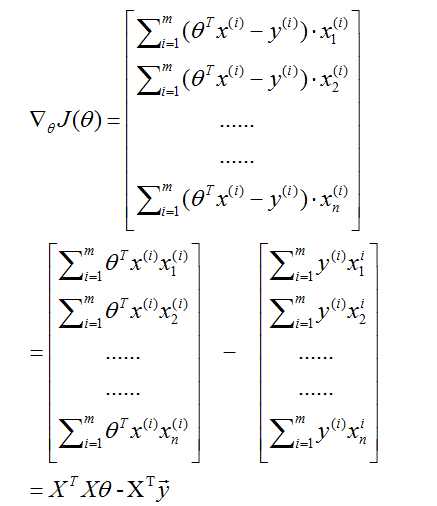

關於 的偏導數

的偏導數

上式即為向量

的第

的第 個元素,所以

個元素,所以

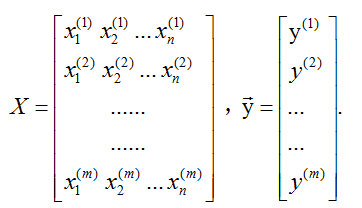

其中,

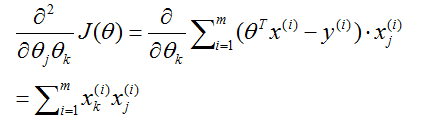

然後求解海森矩陣,

所以,

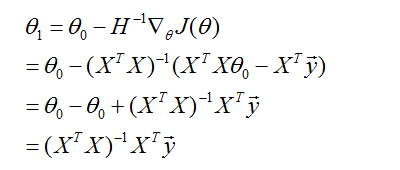

從而選擇隨機初始值

,一次迭代後,

,一次迭代後,

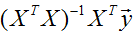

我們發現無論

取什麼值,一次迭代後

取什麼值,一次迭代後 都為

都為 ,而此值恰恰為使得

,而此值恰恰為使得 取最小值的

取最小值的 值。(具體證明請點選此)。

值。(具體證明請點選此)。因此,牛頓法經過一步迭代,即可求解最小二乘問題。

相關推薦

牛頓法求解最小二乘問題(線性迴歸)

用牛頓法求解代價函式的最小值,這裡是n維向量,是實數。 解 牛頓法(詳細點此)迭代公式為, 這裡,是關於的偏導數向量;是一個n x n被稱作Hessian的矩陣,其元素為。 先求關於的偏導數 上式

機器學習(四)——最小二乘(Least squares)

藉助舉證導數的工具,現在讓我們繼續以封閉的形式找到θ的值,使得J(θ)最小化。我們從用矩陣向量表示法重寫J開始。給定一個訓練集,設計矩陣X為mxn矩陣,(實際上是mx(n+1),如果我們包括攔截項),其中每一行為訓練樣本的輸入值:另外,讓是包含訓練集中所有目標值的m維向量:現

梯度下降法,最小二乘法求線性迴歸

一.梯度下降法: 我們假設迴歸函式為: ,這裡x0 = 1. 定義迴歸函式和實際值之間差的均方和為損失函式: ,m為樣本數量 我們的目的是求出使損失函式最小的引數的值。求最小值,對於每個引數,求出梯度並使梯度等於0,此時的即為對於引數來說,損失

R語言與點估計學習筆記(刀切法與最小二乘估計)

一、 刀切法(jackknife) 刀切法的提出,是基於點估計準則無偏性。刀切法的作用就是不斷地壓縮偏差。但需要指出的是縮小偏差並不是一個好的辦法,因為偏差趨於0時,均方誤差會變得十分大。而且無偏性只有在大量重複時才會表現出與真值的偏差不大。Ja

2018.08.28 ali 梯度下降法實現最小二乘

4.3 div 數量 ask pre oss 找到 1.7 二維 - 要理解梯度下降和牛頓叠代法的區別 #include<stdio.h> // 1. 線性多維函數原型是 y = f(x1,x2,x3) = a * x1 + b * x2 + c * x

matlab練習程序(最小二乘多項式擬合)

相關 sum 因此 使用 val fit width clas height 最近在分析一些數據,就是數據擬合的一些事情,用到了matlab的polyfit函數,效果不錯。 因此想了解一下這個多項式具體是如何擬合出來的,所以就搜了相關資料。 這個文檔介紹的還不錯,我估計

偏最小二乘(pls)迴歸分析 matlab

偏最小二乘用於查詢兩個矩陣(X和Y)的基本關係,即一個在這兩個空間對協方差結構建模的隱變數方法。偏最小二乘模型將試圖找到X空間的多維方向來解釋Y空間方差最大的多維方向。偏最小二乘迴歸特別適合當預測矩陣比觀測的有更多變數,以及X的值中有多重共線性的時候。通過投影預測變數和觀測變

Andrew Ng機器學習筆記2——梯度下降法and最小二乘擬合

今天正式開始學習機器學習的演算法,老師首先舉了一個例項:已知某地區的房屋面積與價格的一個數據集,那麼如何預測給定房屋面積的價格呢?我們大部分人可以想到的就是將畫出房屋面積與價格的散點圖,然後擬合出價格關於面積的曲線,那麼對於一個已知的房屋面積,就可以在擬合的曲線上得到預測的

校正模型(多項式校正和布林薩模型及最小二乘引數解算)

最近需要實現一個根據控制點進行座標校正的功能,查了資料發現校正模型比較多,由於是地理座標的校正,所以文章中主要提到的布林薩模型,由於之前接觸過影象的校正,在影象校正中則主要使用的是多項式校

SVD(奇異值分解)及求解最小二乘問題

1. SVD 任意矩陣A (mxn), 都能被奇異值分解為: 其中, U是mxm的正交矩陣, V是nxn的正交矩陣, Σr是由r個沿對角線從大到小排列的奇異值組成的方陣. r就是矩陣A的秩. 2. Moore-Pseudo逆 任意矩陣A, 若存在矩陣X, 使得:

加權最小二乘(wls)濾波演算法原理及實現

加權最小二乘濾波WLS(weighted least squares)加上雙邊濾波,引導濾波是三種較為經典的邊緣保持性濾波演算法,該演算法最早見於論文:《Edge-Preserving Decompositions for Multi-Scale Tone and Det

投影矩陣與最小二乘(二)

咱們繼續說最小二乘的故事,因為Strang把這些東西以一種非常直觀的形式串聯起來,使我迫不及待地想寫一些心得 在上回,我們得到了一個十分重要的東西,投影矩陣: p = A(A'A)-1A' 我們依然以在(一)中的那張投影圖為例,b在平面上的投影是p,如果b垂直於C(A),那

資料分析——最小二乘法建立線性迴歸方程(最簡單的一元線性模型為例)

概述 別看公式多,其實很簡單 最小二乘法其實又叫最小平方法,是一種資料擬合的優化技術。實質上是利用最小誤差的平方尋求資料的最佳匹配函式,利用最小二乘法可以便捷的求得未知的資料,起到預測的作用,並且是的這些預測的資料與實際資料之間的誤差平方和達到最小。一般應用在曲線擬合的目的上。 原理

迴歸分析中的引數估計為何是最小二乘法(least squares),不是最小一乘法(least absolute deviations)

如題,面試被問到了。今天網上找了些資料,整理了一下。 迴歸分析就是找到一條最合適的擬合線來逼近所有的觀測點。如何衡量擬合的好壞程度呢,直接地,就是看擬合值與觀測值之間的距離了。在這種情況下,我們直接用擬合值與觀測值差的絕對值就可以衡量誤差(如公式1),為什麼要用差的平方呢(

python3__機器學習__神經網路基礎演算法__最小二乘法(LS演算法)

1.LS演算法說明 LS演算法是一種數學優化技術,也是一種機器學習常用演算法。他通過最小化誤差的平方和尋找資料的最佳函式匹配。利用最小二乘法可以簡便的求得未知的資料(1),並使得這些求得的資料與實際資料之間誤差的平方和最小。除此之外最小二乘法還可用於曲線擬合(2),其他一些優化問題(

純數學手段實現基於最小二乘法的線性迴歸

終於,抱著興趣,我利用純數學的手段實現了基於最小二乘法的線性迴歸模型。這是我昨天的目標(今天我還沒有睡覺呢,假設我睡覺後是明天的話),那麼我明天希望能夠利用純數學手段實現基於隨機梯度下降的線性迴歸演算法模型。 下面是筆者手打的最小二乘法的數學原理,然後我們再

MIT18.06課程筆記16:最小二乘法,線性迴歸

課程簡介 課程筆記 1. 線性迴歸問題簡介 簡單敘述:給定一系列的資料點(例如{(x1,y1),(x2,y2)...},其中x表示特徵向量,y表示目標值),求取一個線性函式(例如一維直線就是y=cx+d)擬合數據點,即使得函式值的誤差的平方和最

機器學習_最小二乘法,線性迴歸與邏輯迴歸

1. 線性迴歸 線性迴歸是利用數理統計中迴歸分析,來確定兩種或兩種以上變數間相互依賴的定量關係的一種統計分析方法。 直觀地說,在二維情況下,已知一些點的X,Y座標,統計條件X與結果Y的關係,畫一條直線,讓直線離所有點都儘量地近(距離之和最小),用直線抽象地表達這些點,然後對新的X預測新的Y。具體實現一般

最小二乘法求線性迴歸方程

四組數 (1,2)(2,4)(3,5)(4,7)x平均=(1+2+3+4)/4=2.5y平均=(2+4+5+7)/4=4.5b=(53-4*2.5*4.5)/(30-4*2.5²)=8/5=1.6a=4.5-1.6*2.5=0.5∴迴歸直線為y=1.6x+0.5

[ch04-01] 用最小二乘法解決線性迴歸問題

系列部落格,原文在筆者所維護的github上:https://aka.ms/beginnerAI, 點選star加星不要吝嗇,星越多筆者越努力。 4.1 最小二乘法 4.1.1 歷史 最小二乘法,也叫做最小平方法(Least Square),它通過最小化誤差的平方和尋找資料的最佳函式匹配。利用最小二乘法可以簡