idea在本地調試,spark創建hiveContext的時候報錯

阿新 • • 發佈:2019-04-03

image onf sca etl () pan ray apache strong

spark版本:1.6.1

scala版本:2.10

問題呢場景:

在idea調試本地程序的時候創建hiveContext報錯,上午的時候是沒有這個問題的,下午在項目中寫了一個小deamon,出現了而這個問題,下面是我的代碼:

import cn.com.xxx.common.config.SparkConfig

import org.apache.spark.sql.hive.HiveContext

object test{

def main(args: Array[String]): Unit = {

SparkConfig.init("local[2]", this.getClass.getName)

val sc = SparkConfig.getSparkContext()

sc.setLogLevel("WARN")

val hqlContext = new HiveContext(sc)

println("hello")

sc.stop()

}

}

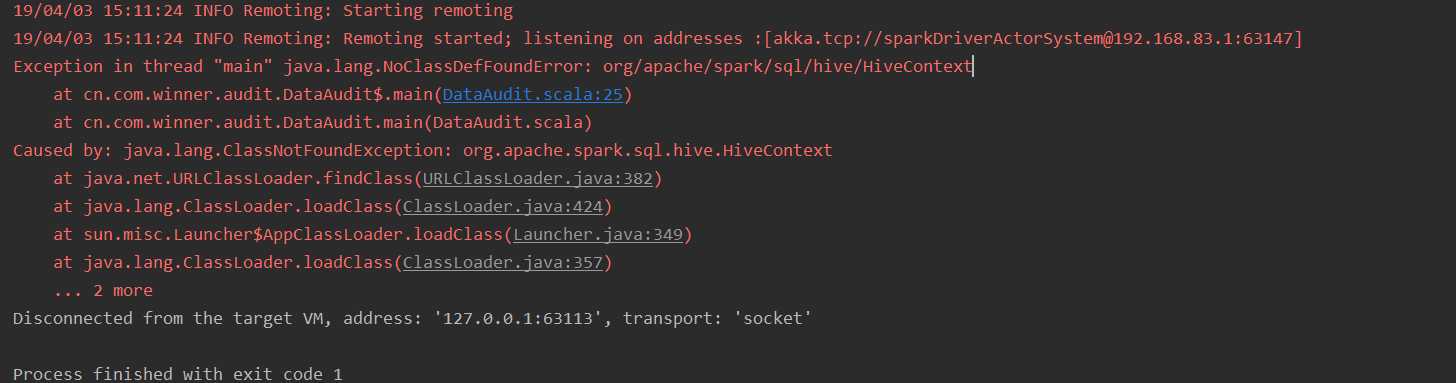

報錯:

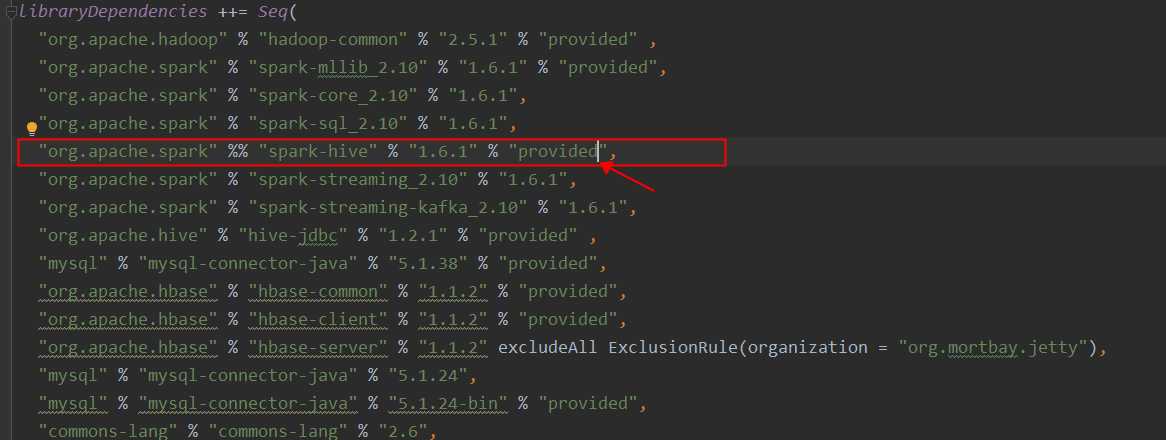

苦惱了一早晨,開始是以為我的依賴包沒有下載,但是查看我的sbt的中的built.sbt文件中是有這個包的,跟蹤源碼,找度娘,等等,最終找到問題,最後定位到問題,是因為這個spark-hive依賴包的類型設置錯誤了:

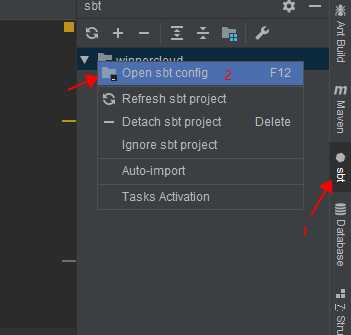

順便說一下,idea中我是怎麽找到built.sbt文件的:

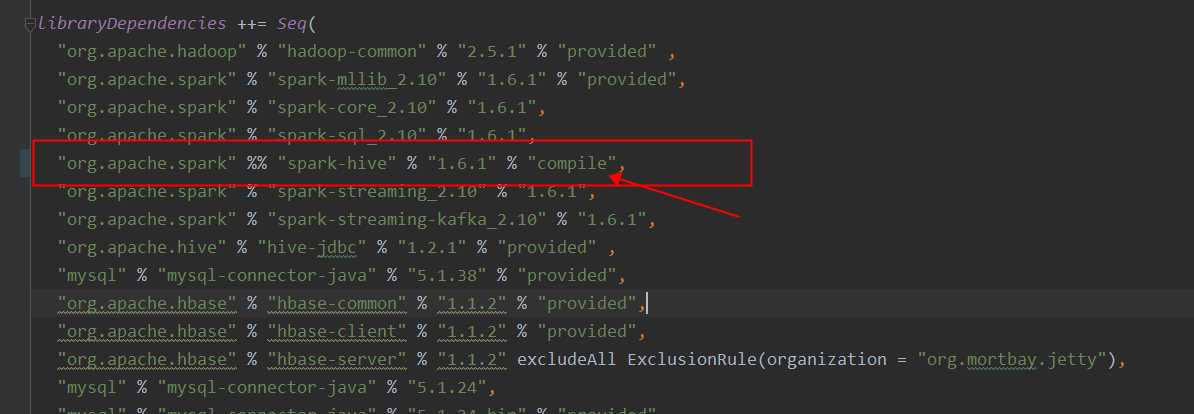

罪魁禍首就是這個單詞,需要將這裏改為"compile",如下圖:

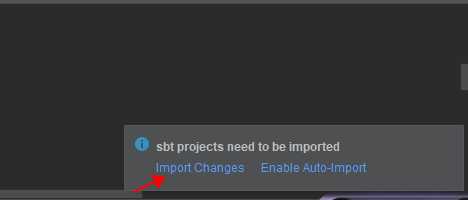

,然後,點擊右下角出現的提示,import:

等待更新結束之後,然後在此進行編譯,成功

大坑啊,這裏記錄一下,防止以後再次遇到

idea在本地調試,spark創建hiveContext的時候報錯