[知乎]機器學習中使用正則化來防止過擬合是什麼原理?

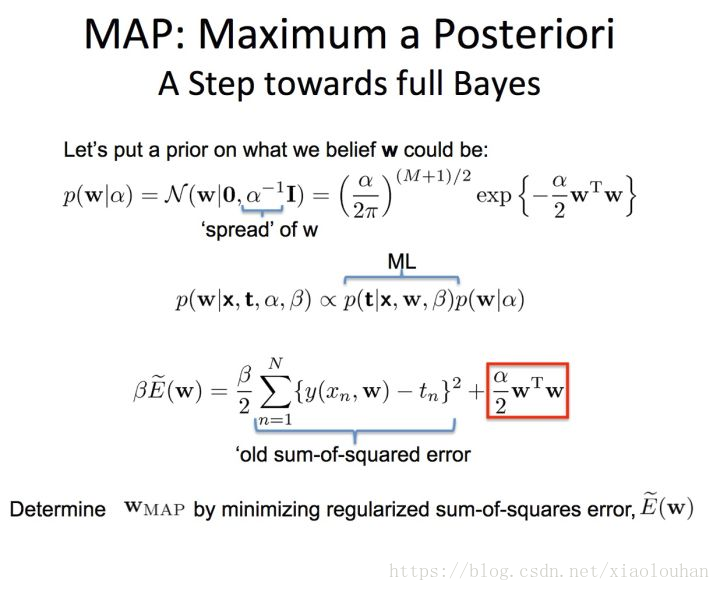

我們相當於是給模型引數w 添加了一個協方差為1/alpha 的零均值高斯分佈先驗。 對於alpha =0,也就是不新增正則化約束,則相當於引數的高斯先驗分佈有著無窮大的協方差,那麼這個先驗約束則會非常弱,模型為了擬合所有的訓練資料,w可以變得任意大不穩定。alpha越大,表明先驗的高斯協方差越小,模型約穩定, 相對的variance也越小。

作者:Alan Huang

連結:https://www.zhihu.com/question/20700829/answer/35306184

來源:知乎

著作權歸作者所有。商業轉載請聯絡作者獲得授權,非商業轉載請註明出處。

![]()

知乎使用者

-

經典的是bias-variance decomposition,但個人認為這種解釋更加傾向於直觀理解;

-

PAC-learning 泛化界解釋,這種解釋是最透徹,最fundamental的;

-

Bayes先驗解釋,這種解釋把正則變成先驗,在我看來等於沒解釋。

相關推薦

[知乎]機器學習中使用正則化來防止過擬合是什麼原理?

我們相當於是給模型引數w 添加了一個協方差為1/alpha 的零均值高斯分佈先驗。 對於alpha =0,也就是不新增正則化約束,則相當於引數的高斯先驗分佈有著無窮大的協方差,那麼這個先驗約束則會非常弱,模型為了擬合所有的訓練資料,w可以變得任意大不穩定。alph

吳恩達深度學習筆記(31)-為什麼正則化可以防止過擬合

為什麼正則化有利於預防過擬合呢?(Why regularization reduces overfitting?) 為什麼正則化有利於預防過擬合呢?為什麼它可以減少方差問題?我們通過兩個例子來直觀體會一下。 左圖是高偏差,右圖是高方差,中間是Just Right,這幾張圖我們在前面

正則化方法/防止過擬合提高泛化能力的方法:L1和L2 regularization、資料集擴增、dropout

正則化方法:防止過擬合,提高泛化能力 在訓練資料不夠多時,或者overtraining時,常常會導致overfitting(過擬合)。其直觀的表現如下圖所示,隨著訓練過程的進行,模型複雜度增加,在training data上的error漸漸減小,但是在驗證集上的e

[work*] 機器學習中正則化項L1和L2的直觀理解

正則化(Regularization) 機器學習中幾乎都可以看到損失函式後面會新增一個額外項,常用的額外項一般有兩種,一般英文稱作-norm和-norm,中文稱作L1正則化和L2正則化,或者L1範數和L2範數。 L1正則化和L2正則化可以看做是損失函式的懲罰項。所謂『懲罰

機器學習中正則化項L1和L2的直觀理解

正則化(Regularization) 機器學習中幾乎都可以看到損失函式後面會新增一個額外項,常用的額外項一般有兩種,一般英文稱作ℓ1ℓ1-norm和ℓ2ℓ2-norm,中文稱作L1正則化和L2正則化,或者L1範數和L2範數。 L1正則化和L2正則化可以看做

吳恩達機器學習(五)正則化(解決過擬合問題)

目錄 0. 前言 學習完吳恩達老師機器學習課程的正則化,簡單的做個筆記。文中部分描述屬於個人消化後的理解,僅供參考。 0. 前言 在分類或者回歸時,通常存在兩個問題,“過擬合”(overfitting)和“欠擬合”(underfitting). 過擬

機器學習筆記05:正則化(Regularization)、過擬合(Overfitting)

說明:文章中的所有圖片均屬於Stanford機器學習課程 (一)過擬合問題(The Problem of Overfitting) 不管是在線性迴歸還是在邏輯迴歸中,我們都會遇到過擬合的問題。先從例子來看看什麼是過擬合。 i.線性迴歸中的過擬合

為什麼正則化可以減小過擬合?(收藏)

1.cs231n課程筆記 2.吳恩達老師課程筆記 特徵變數過多會導致過擬合,為了防止過擬合會選擇一些比較重要的特徵變數,而刪掉很多次要的特徵變數。但是,如果我們實際上卻希望利用到這些特徵資訊,所以可以新增正則化項來約束這些特徵變數,使得這些特徵變數的權重很小,接近於0,這樣既能保留這些特徵變數,又不至

為什麼正則化能夠降低過擬合

我們通過實驗發現正則化能幫助減少過擬合。這是令人高興的事,然而不幸的是,我們沒有明顯的證據證明為什麼正則化可以起到這個效果!一個大家經常說起的解釋是:在某種程度上,越小的權重複雜度越低,因此能夠更簡單且更有效地描繪資料,所以我們傾向於選擇這樣的權重。儘管這是個很簡短的解釋,卻

tensorflow使用L2 regularization正則化修正overfitting過擬合

L2正則化原理: 在Loss中加入引數w的平方和,這樣訓練過程中就會抑制w的值,w的值小,曲線就比較平滑,從而減小過擬合,參考公式如下圖: 正則化是不影響你去擬合曲線的,並不是所有引數都會被無腦抑制,實際上這是一個動態過程,是cross_entropy和L2 loss

Coursera | Andrew Ng (02-week-1-1.5)—為什麼正則化可以減少過擬合?

該系列僅在原課程基礎上部分知識點添加個人學習筆記,或相關推導補充等。如有錯誤,還請批評指教。在學習了 Andrew Ng 課程的基礎上,為了更方便的查閱複習,將其整理成文字。因本人一直在學習英語,所以該系列以英文為主,同時也建議讀者以英文為主,中文輔助,以便後期

Bobo老師機器學習筆記第八課-如何防止過擬合和欠擬合?

問題一、什麼是過擬合和欠擬合? 首先擬合是一個統計學概念,它表示所求函式逼近目標函式的遠近程度。應用的機器學習中,就是我們所求的函式與未知的對映函式之間的相似度。如何求得函式引數與潛在的函式引數越逼近,說明效果越好。 假設我們用上篇部落格中的資料,原始碼可以見上文: 通

ng機器學習視頻筆記(五) ——過擬合與正則化

哪些 重復 關註 osi 現實 regular 鏈接 梯度下降 簡單 ng機器學習視頻筆記(五) ——過擬合與正則化 (轉載請附上本文鏈接——linhxx) 一、過擬合和欠擬合 1、概念 當針對樣本集和特征值,進行預測的時候,推導θ、梯度下降等,都在

機器學習:正則化技術

正則化(regularization)技術是機器學習中十分常用的技術,它在不同的模型或者情景中以不同的名字出現,比如以L2正則化為例,如果將L2正則化用於linear regression,那麼這就對應了ridge regression;如果將L2正則化用於神經網路(neural network),

【機器學習】正則化方法

正則化方法:L1和L2 regularization、資料集擴增、dropout 正則化方法:防止過擬合,提高泛化能力,減少部分特徵的權重,進而忽略部分無關緊要的特徵。因為考慮全部特徵會將噪聲加入進去,也就導致過擬合。 在訓練資料不夠多時,或者overtraining時,常常會導致overf

【機器學習】正則化的線性迴歸 —— 嶺迴歸與Lasso迴歸

注:正則化是用來防止過擬合的方法。在最開始學習機器學習的課程時,只是覺得這個方法就像某種魔法一樣非常神奇的改變了模型的引數。但是一直也無法對其基本原理有一個透徹、直觀的理解。直到最近再次接觸到這個概念,經過一番苦思冥想後終於有了我自己的理解。 0. 正則化(

機器學習中正則懲罰項L0/L1/L2範數詳解

https://blog.csdn.net/zouxy09/article/details/24971995 原文轉自csdn部落格,寫的非常好。 L0: 非零的個數 L1: 引數絕對值的和 L2:引數平方和

機器學習筆記——正則化(regularization)

正則化 過擬合 我們在利用資料來進行曲線擬合的時候會出現三種情況,欠擬合(underfitting),合適(just right),過擬合(overfitting)。欠擬合的情況一般是由於變數太少,而過擬合的原因一般是變數太多 下面我們主要考慮過擬合的問題。過擬合的解決方法一

機器學習5 正則化的線性迴歸(Regularized Linear Regression)和偏差對方差(Bias v.s. Variance)

在這篇博文中我們將會實現正則化的線性迴歸以及利用他去學習模型,不同的模型會具有不同的偏差-方差性質,我們將研究正則化以及偏差和方差之間的相互關係和影響。 這一部分的資料是關於通過一個水庫的水位來預測水庫的流水量。為了進行偏差和方差的檢驗,這裡用12組資料進行迴

機器學習之正則化(Regularization)

1. The Problem of Overfitting 1 還是來看預測房價的這個例子,我們先對該資料做線性迴歸,也就是左邊第一張圖。 如果這麼做,我們可以獲得擬合數據的這樣一條直線,但是,實際上這並不是一個很好的模型。我們看看這些資料,很明顯,隨著房子面積增大,住房價格的變化趨於穩定或者說越往右越平緩