分類-3-生成學習-3-樸素貝葉斯模型、laplace平滑、多元伯努利事件模型、多項式事件模型

多元伯努利事件模型( multi-variate Bernoulli event model)

在 GDA 中,我們要求特徵向量 x 是連續實數向量。如果 x 是離散值的話,可以考慮採用樸素貝葉斯的分類方法。

假如要分類垃圾郵件和正常郵件。

舉個例子如下:

郵件中包含“a”,”buy”且字典

而郵件中的單詞“aardvark”,“aardwolf”,“zygmurgy”並沒有出現在字典中,這類單詞我們忽略它們;

而對於字典中未在郵件中出現過的單詞,對應的位置我們置為0。

我們的目的是為了建立模型

假如字典中的單詞數為50000,這時就會有

begin-補充:多項式分佈模型(二項式分佈的擴充套件)

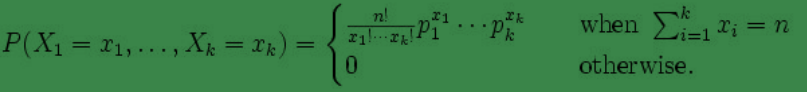

多項式分佈( multinomial distribution)

某隨機實驗如果有 k 個可能結局

end-補充

因此,我們假設當

注:假設中是

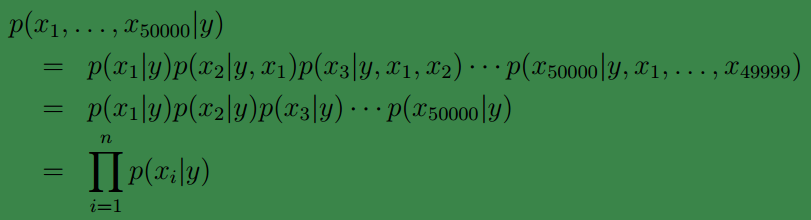

在樸素貝葉斯假設下我們有:、

因此我們的原問題可寫為下面的形式:

第一個等式根據概率密度鏈式法則得到,第二個等式由樸素貝葉斯假設得到。

下面給出我們模型的引數:

首先回想樸素貝葉斯公式: