大資料學習系列之七 ----- Hadoop+Spark+Zookeeper+HBase+Hive叢集搭建 圖文詳解

引言

在之前的大資料學習系列中,搭建了Hadoop+Spark+HBase+Hive 環境以及一些測試。其實要說的話,我開始學習大資料的時候,搭建的就是叢集,並不是單機模式和偽分散式。至於為什麼先寫單機的搭建,是因為作為個人學習的話,單機已足以,好吧,說實話是自己的電腦不行,使用虛擬機器實在太卡了。。。 整個的叢集搭建是在公司的測試服務搭建的,在搭建的時候遇到各種各樣的坑,當然也收穫頗多。在成功搭建大資料叢集之後,零零散散的做了寫筆記,然後重新將這些筆記整理了下來。於是就有了本篇博文。 其實我在搭建的時候,並不是按部就班的搭建,中間或多或少都更改過不少,試驗出來了目前沒啥問題的叢集搭建。在寫本文的時候,開始準備將環境在一臺機器上搭建,然後全部傳輸到其他機器上。但是想了想,這樣或許在搭建環境的時候快速,但是對於閱讀者來說,不太友好。於是便拆分出來了,單獨搭建一個也是可以的。好了,廢話就少說了,教程如下。

目錄

一、環境選擇

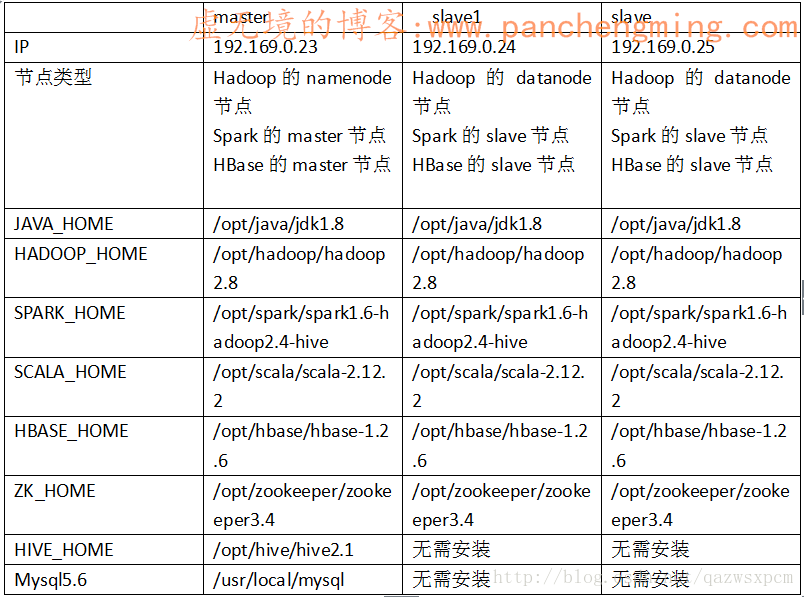

1,叢集機器安裝圖

這次因為是叢集搭建,所以在環境配置方面,我使用一張表格來大致描述。叢集使用了3臺機器,分別是master、slave1、slave2,通過名稱命名就可以知道主從關係了。使用的作業系統是CentOS6.8,具體各個機器安裝的配置如下表格:

具體每個機器的配置就如上圖了。需要補充的是,spark這塊我沒有使用官方自帶的spark,而是使用的已經編譯好的spark和hive的版本。因為後面在使用hive查詢的時候,不想使用hive預設的mr,在hive2.x之後,官方也不建議了。因為使用mr效率實在太低,所以在後面我會將hive的引擎換成spark,而自己又不想重新編譯spark ,所以就用這個版本了。如果各位想自行編譯,或者出現更高的版本,就沒必要一定按照上面的來。還有存放路徑這塊,沒必要一定要使用上面的,可以先在機器上使用 df -h 檢視相應的磁碟空間,再來進行部署。

2,配置說明

- JDK :Hadoop和Spark 依賴的配置,官方建議JDK版本在1.7以上!!!

- Scala:Spark依賴的配置,建議版本不低於spark的版本。

- Hadoop: 是一個分散式系統基礎架構。

- Spark: 分散式儲存的大資料進行處理的工具。

- zookeeper:分散式應用程式協調服務,HBase叢集需要。

- HBase: 一個結構化資料的分散式儲存系統。

- Hive: 基於Hadoop的一個數據倉庫工具,目前的預設元資料庫是mysql。

3,下載地址

二、叢集的相關配置

1,主機名更改以及主機和IP做相關對映

1. 更改主機名

說明:更改主機名是為了方便叢集管理,不然每個機器的名稱都叫localhost也不太好吧! 叢集所有的機器都要做這個操作。

輸入

vim /etc/sysconfig/network 將localhost.localdomain修改為你要更改的名稱,每臺名稱都不一樣

例如:

HOSTNAME=master注: 名稱更改了之後輸入reboot重啟才會生效。

2.做主機和IP的關係對映

修改hosts檔案,做關係對映

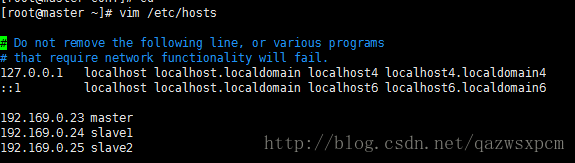

說明:這個每臺機器都做這個配置,具體ip和主機名稱以自己的為準。

輸入:

vim /etc/hosts新增

192.169.0.23 master

192.169.0.24 slave1

192.169.0.25 slave2

說明:可以在一臺機器添加了之後可以使用scp 命令或使用ftp將這個檔案copy到 其他機器中。

scp命令示例:

scp -r /etc/hosts root@192.169.0.24:/etc2,ssh免登入

設定ssh免密碼登入是為了操作方便

生成祕鑰檔案

在每臺機器上都執行一遍

首先輸入:

ssh-keygen -t rsa -P ''生成祕鑰之後,然後將每臺機器/root/.ssh 都存入內容相同的檔案,檔名稱叫authorized_keys,檔案內容是我們剛才為3臺機器生成的公鑰。可以在一臺機器上生成,然後複製到其它的機器上。

新建authorized_keys檔案

輸入 :

touch /root/.ssh/authorized_keys編輯 authorized_keys 並將其他機器上的祕鑰拷貝過來

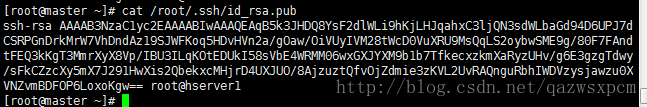

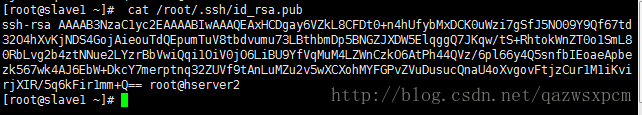

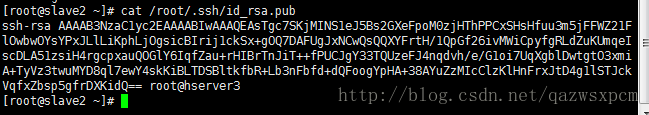

cat /root/.ssh/id_rsa.pub

vim /root/.ssh/authorized_keys將其它機器上的 id_rsa.pub 的內容拷貝到 authorized_keys這個檔案中。

第一個機器:

第二個機器:

第三個機器:

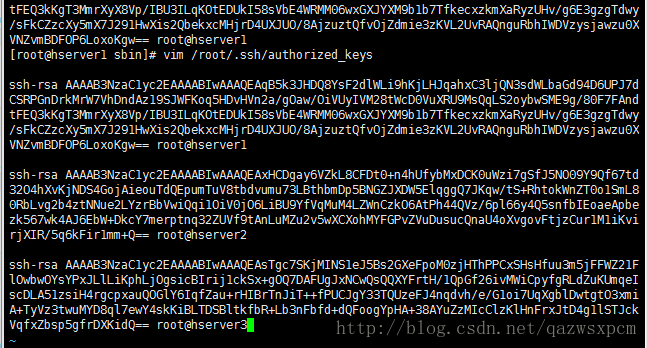

最終authorized_keys檔案的內容

將這個最終的authorized_keys檔案copy到其他機器的 /root/.ssh 目錄下。使用scp或者ftp都可以。

scp命令示例:

scp -r /root/.ssh/authorized_keys root@192.169.0.24:/root/.ssh測試免密碼登入

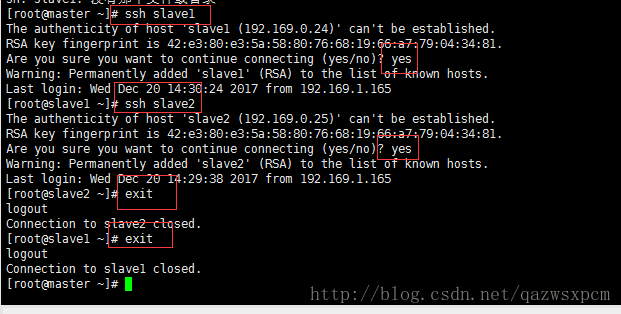

輸入:

ssh slave1

ssh slave2輸入 exit 退出

3,防火牆關閉

說明:其實可以不關閉防火牆,進行許可權設定,但是為了方便訪問,於是便關閉了防火牆。每個機器都做!!!

關閉防火牆的命令

停止防火牆:

service iptables stop

啟動防火牆:

service iptables start

重啟防火牆:

service iptables restart

永久關閉防火牆:

chkconfig iptables off

4,時間配置

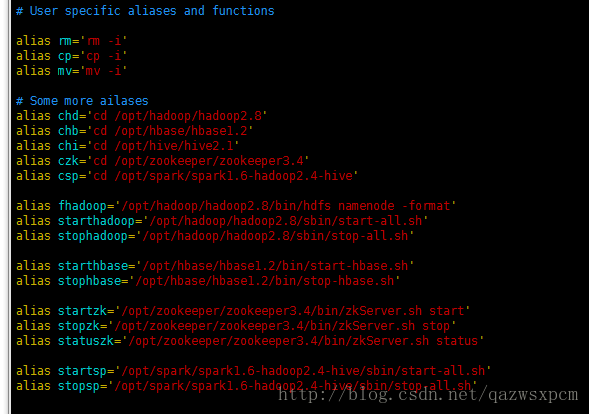

5,快捷鍵設定(可選)

說明:因為要經常切換各個目錄之間,所以為了偷懶,就設定別名了。只需要在linux輸入別名,就可以執行別名後面的命令,相當的方便。 例如:我們常用的ll就是 ls -l 的別名。關於別名這塊各位可以自行摸索。

輸入:

vim ~/.bashrc新增下面的內容

# Some more ailases

alias chd='cd /opt/hadoop/hadoop2.8'

alias chb='cd /opt/hbase/hbase1.2'

alias chi='cd /opt/hive/hive2.1'

alias czk='cd /opt/zookeeper/zookeeper3.4'

alias csp='cd /opt/spark/spark2.0-hadoop2.4-hive'

alias fhadoop='/opt/hadoop/hadoop2.8/bin/hdfs namenode -format'

alias starthadoop='/opt/hadoop/hadoop2.8/sbin/start-all.sh'

alias stophadoop='/opt/hadoop/hadoop2.8/sbin/stop-all.sh'

alias starthbase='/opt/hbase/hbase1.2/bin/start-hbase.sh'

alias stophbase='/opt/hbase/hbase1.2/bin/stop-hbase.sh'

alias startzk='/opt/zookeeper/zookeeper3.4/bin/zkServer.sh start'

alias stopzk='/opt/zookeeper/zookeeper3.4/bin/zkServer.sh stop'

alias statuszk='/opt/zookeeper/zookeeper3.4/bin/zkServer.sh status'

alias startsp='/opt/spark/spark1.6-hadoop2.4-hive/sbin/start-all.sh'

alias stopsp='/opt/spark/spark1.6-hadoop2.4-hive/sbin/stop-all.sh'成功新增之後輸入

source ~/.bashrc然後輸入設定的別名就可以執行你所設定的內容了。別名的設定不一定非要按照上面的,如果有更好方式就請使用

6,整體環境變數設定

在 /etc/profile 這個配置檔案要新增很多的環境配置,這裡就先將整體的環境配置列舉出來,各位在配置環境變數的以自己的為準!!! 可以先配置好環境變數之後,在傳輸到其他機器上去。

我這裡先將這些配置都傳輸到其他的機器上了,並且都source了,所以下文中這個配置檔案的操作實際是沒做的。具體情況以自己的為準。

#Java Config

export JAVA_HOME=/opt/java/jdk1.8

export JRE_HOME=/opt/java/jdk1.8/jre

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar:$JRE_HOME/lib

# Scala Config

export SCALA_HOME=/opt/scala/scala2.12

# Spark Config

export SPARK_HOME=/opt/spark/spark1.6-hadoop2.4-hive

# Zookeeper Config

export ZK_HOME=/opt/zookeeper/zookeeper3.4

# HBase Config

export HBASE_HOME=/opt/hbase/hbase1.2

# Hadoop Config

export HADOOP_HOME=/opt/hadoop/hadoop2.8

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib"

# Hive Config

export HIVE_HOME=/opt/hive/hive2.1

export HIVE_CONF_DIR=${HIVE_HOME}/conf

export PATH=.:${JAVA_HOME}/bin:${SCALA_HOME}/bin:${SPARK_HOME}/bin:${HADOOP_HOME}/bin:${HADOOP_HOME}/sbin:${ZK_HOME}/bin:${HBASE_HOME}/bin:${HIVE_HOME}/bin:$PATH二、Hadoop的環境搭建

事先說明,這些配置可以在一臺機器上配置,然後複製到其他機器上就行了。複製之後注意使這些配置檔案生效。

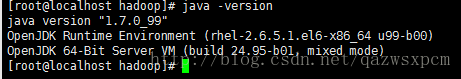

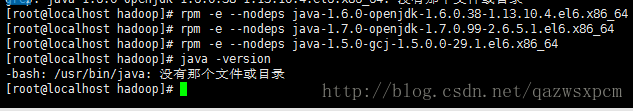

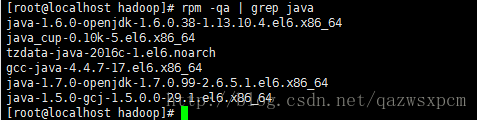

1,JDK配置

說明: 一般CentOS自帶了openjdk,但是hadoop叢集使用的是oracle官方的jdk,所以先行解除安裝CentOS的jdk,然後再安裝在oracle下載好的JDK。

首先輸入 java -version

檢視是否安裝了JDK,如果安裝了,但版本不適合的話,就解除安裝

輸入

rpm -qa | grep java

檢視資訊

然後輸入:

rpm -e –nodeps “你要解除安裝JDK的資訊”

如: rpm -e –nodeps java-1.7.0-openjdk-1.7.0.99-2.6.5.1.el6.x86_64

確認沒有了之後,解壓下載下來的JDK

tar -xvf jdk-8u144-linux-x64.tar.gz移動到opt/java資料夾中,沒有就新建,然後將資料夾重新命名為jdk1.8。

mv jdk1.8.0_144 /opt/java

mv jdk1.8.0_144 jdk1.8然後編輯 profile 檔案,新增如下配置

輸入:

vim /etc/profile新增:

export JAVA_HOME=/opt/java/jdk1.8

export JRE_HOME=/opt/java/jdk1.8/jre

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar:$JRE_HOME/lib

export PATH=.:${JAVA_HOME}/bin:$PATH新增成功之後,輸入

source /etc/profile

java -version 檢視是否配置成功

2,hadoop配置

3.2.1 檔案準備

將下載下來的Hadoop的配置檔案進行解壓

在linux上輸入:

tar -xvf hadoop-2.8.2.tar.gz然後將解壓之後的資料夾移動到opt/hadoop資料夾下,沒有該資料夾就新建,然後將資料夾重新命名為hadoop2.8。

在linux上輸入移動資料夾命令:

mv hadoop-2.8.2 /opt/hadoop

mv hadoop-2.8.2 hadoop2.83.2.2 環境配置

編輯 /etc/profile 檔案

輸入:

vim /etc/profile新增:

export HADOOP_HOME=/opt/hadoop/hadoop2.8

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib"

export PATH=.:${JAVA_HOME}/bin:${HADOOP_HOME}/bin:$PATH輸入:

source /etc/profile使配置生效

3.2.3 修改配置檔案

修改 core-site.xml、hadoop-env.sh、hdfs-site.xml、mapred-site.xml 等這些配置檔案

在linux輸入進入該目錄的命令:

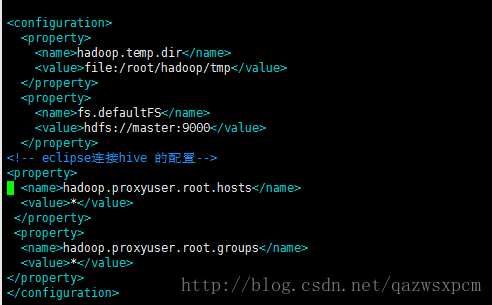

cd /opt/hadoop/hadoop2.8/etc/hadoop3.2.3.1 修改 core-site.xml

hadoop的存放路徑可以自行更改。開始我以為這些資料夾需要手動建立,後來實踐了,如果不手動建立,會自動建立的,所以就去掉了手動建立目錄的步驟。

輸入:

vim core-site.xml在<configuration>節點內加入配置:

<configuration>

<property>

<name>hadoop.temp.dir</name>

<value>file:/root/hadoop/tmp</value>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<!-- eclipse連線hive 的配置-->

<property>

<name>hadoop.proxyuser.root.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.root.groups</name>

<value>*</value>

</property>

</configuration>說明: fs.defaultFS 是預設檔案的名稱, 最早使用的是 fs.default.name,後來在最新官方文件中查到該方法已經棄用了。於是邊改成這個了。ps:感覺也沒啥區別。

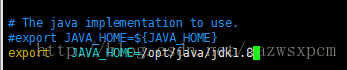

3.2.3.2 修改 hadoop-env.sh

這個要做,不知道為什麼相對路徑不識別,於是就使用絕對路徑。

將

export JAVA_HOME=${JAVA_HOME}修改為:

export JAVA_HOME=/opt/java/jdk1.8注:修改為自己JDK的路徑

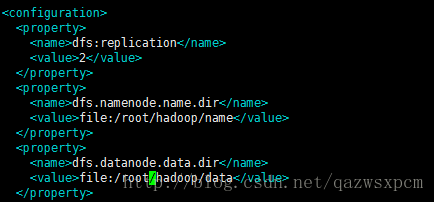

3.2.2.3 修改 hdfs-site.xml

下面的hdfs的存放路徑,可以根據自己機器更改。

在<configuration>節點內加入配置:

<property>

<name>dfs:replication</name>

<value>2</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/root/hadoop/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/root/hadoop/data</value>

</property> 3.5.2.4 修改mapred-site.xml

執行mapreduce的執行框架配置。ps:感覺這個配置沒啥用,可能我沒用mr吧。

如果沒有 mapred-site.xml 該檔案,就複製mapred-site.xml.template檔案並重命名為mapred-site.xml。

修改這個新建的mapred-site.xml檔案,在<configuration>節點內加入配置:

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

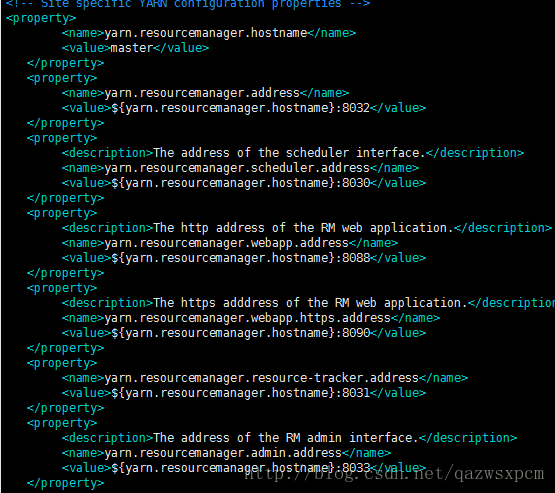

</property>3.5.2.5 修改yarn-site.xml檔案

yarn 資源排程的配置,叢集的話這個配置是必須的。

修改/opt/hadoop/hadoop2.8/etc/hadoop/yarn-site.xml檔案,

在<configuration>節點內加入配置

<property>

<name>yarn.resourcemanager.hostname</name>

<value>master</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>${yarn.resourcemanager.hostname}:8032</value>

</property>

<property>

<description>The address of the scheduler interface.</description>

<name>yarn.resourcemanager.scheduler.address</name>

<value>${yarn.resourcemanager.hostname}:8030</value>

</property>

<property>

<description>The http address of the RM web application.</description>

<name>yarn.resourcemanager.webapp.address</name>

<value>${yarn.resourcemanager.hostname}:8088</value>

</property>

<property>

<description>The https adddress of the RM web application.</description>

<name>yarn.resourcemanager.webapp.https.address</name>

<value>${yarn.resourcemanager.hostname}:8090</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>${yarn.resourcemanager.hostname}:8031</value>

</property>

<property>

<description>The address of the RM admin interface.</description>

<name>yarn.resourcemanager.admin.address</name>

<value>${yarn.resourcemanager.hostname}:8033</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>8182</value>

<discription>每個節點可用記憶體,單位MB,預設8182MB</discription>

</property>

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>2.1</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>說明:yarn.nodemanager.vmem-check-enabled這個的意思是忽略虛擬記憶體的檢查,如果你是安裝在虛擬機器上,這個配置很有用,配上去之後後續操作不容易出問題。如果是實體機上,並且記憶體夠多,可以將這個配置去掉。

3.5.2.6 修改slaves

設定主從的配置。如果不設定這個,叢集就無法得知主從了。如果是單機模式,就沒必要配置了。

修改/opt/hadoop/hadoop2.8/etc/hadoop/slaves檔案

更改為

slave1

slave2在一臺機器上(最好是master)做完這些配置之後,我們使用scp命令將這些配置傳輸到其他機器上。

輸入:

jdk環境傳輸

scp -r /opt/java root@slave1:/opt

scp -r /opt/java root@slave2:/opthadoop環境傳輸

scp -r /opt/hadoop root@slave1:/opt

scp -r /opt/hadoop root@slave2:/opt傳輸之後,便在主節點啟動叢集。

在啟動hadoop之前,需要初始化,這個只需要在master上初始化就可以了。

3,hadoop啟動

注:啟動hadoop之前確保防火牆關閉,各個機器時間通過,ssh免登入都沒問題。

初始化hadoop

切換到/opt/hadoop/hadoop2.8/bin目錄下輸入

./hdfs namenode -format初始化成功之後,切換到/opt/hadoop/hadoop2.8/sbin

啟動hadoop 的hdfs和yarn

輸入:

start-dfs.sh

start-yarn.sh第一次登入會詢問是否連線,輸入yes ,然後輸入密碼就可以了

啟動成功之後,可以使用jps命令在各個機器上檢視是否成功

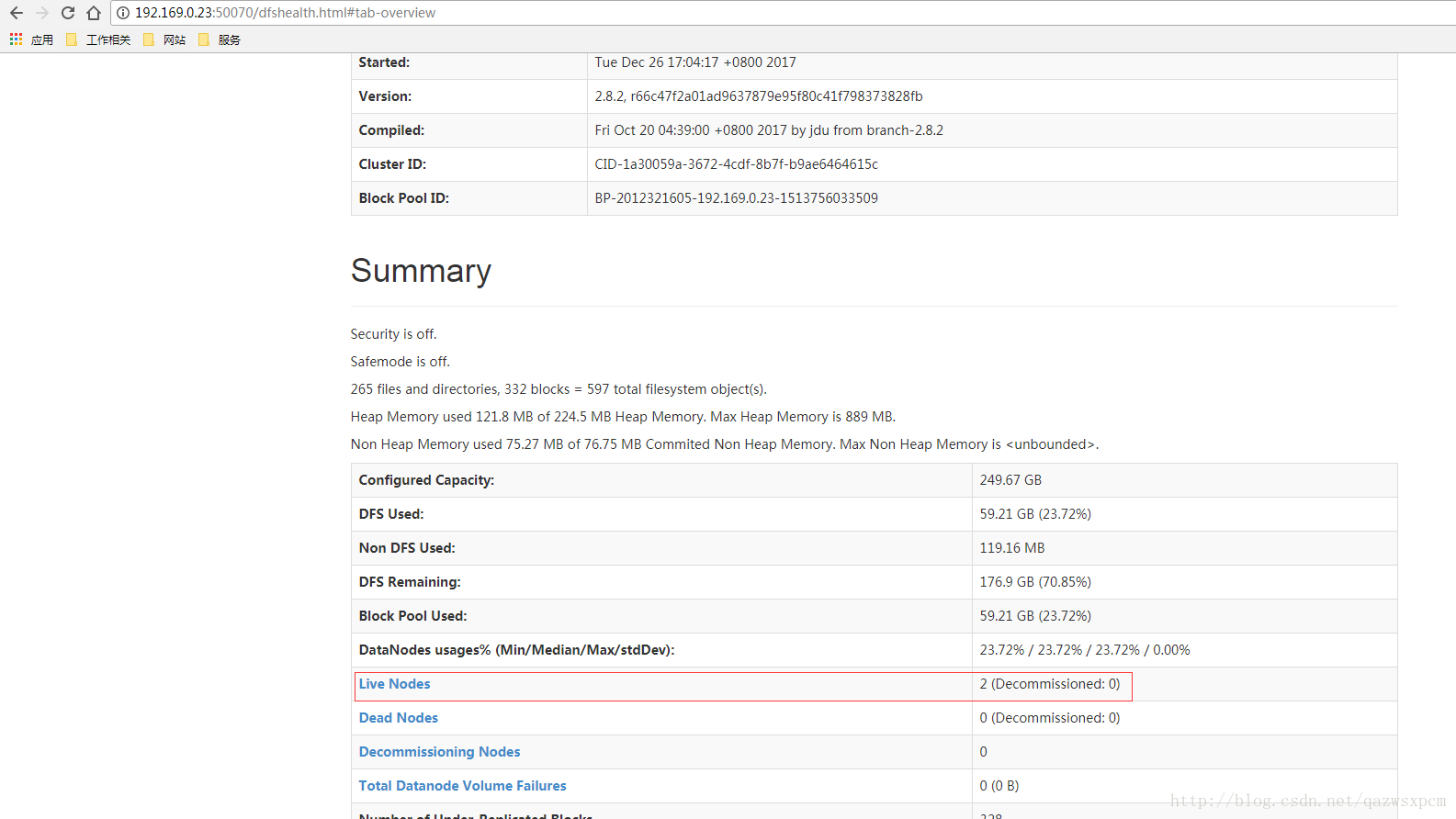

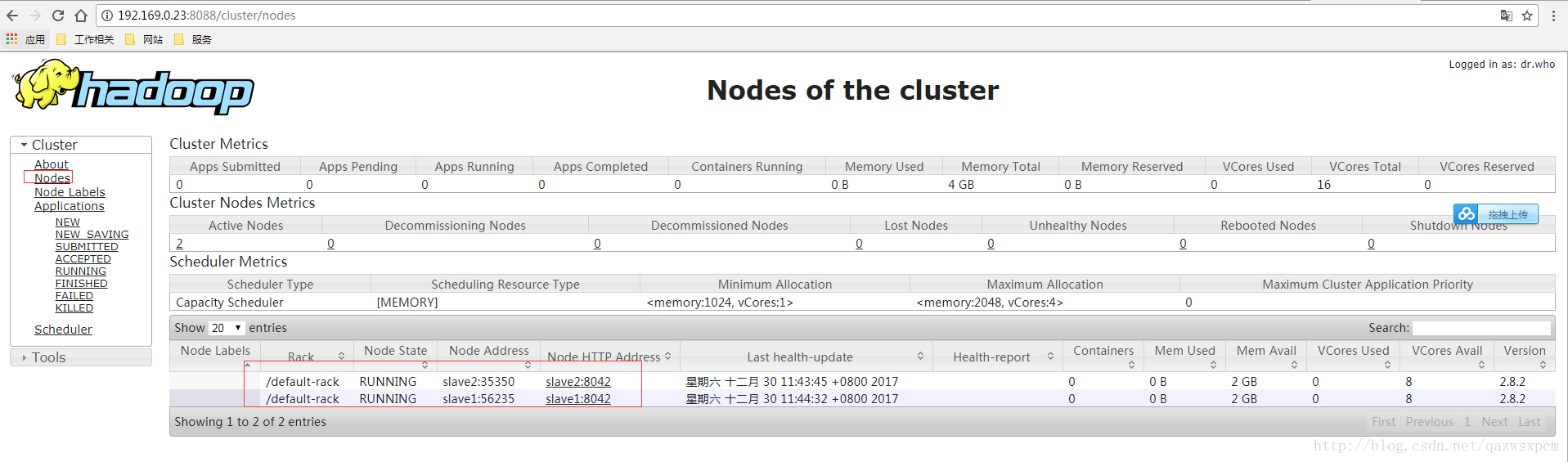

可以在瀏覽器輸入: ip+50070 和8088埠檢視

若如圖顯示,則啟動成功。

若失敗,檢查jps是否成功啟動,防火牆是否都關閉。都確認沒問題之後,還是無法開啟介面,請檢視日誌,再來找原因。

四、Spark的環境配置

1,Scala配置

和JDK配置幾乎一樣

4.1.1 檔案準備

將下載好的Scala檔案解壓

輸入

tar -xvf scala-2.12.2.tgz然後移動到/opt/scala 裡面

並且重新命名為scala2.1

輸入

mv scala-2.12.2 /opt/scala

mv scala-2.12.2 scala2.124.1.2 環境配置

編輯 /etc/profile 檔案

輸入:

export SCALA_HOME=/opt/scala/scala2.12

export PATH=.:${JAVA_HOME}/bin:${SCALA_HOME}/bin:$PATH輸入:

source /etc/profile使配置生效

輸入 scala -version 檢視是否安裝成功

2,Spark配置

4.2.1,檔案準備

將下載好的Spark檔案解壓

輸入

tar -xvf spark-1.6.3-bin-hadoop2.4-without-hive.tgz然後移動到/opt/spark 裡面,並重命名

輸入

mv spark-1.6.3-bin-hadoop2.4-without-hive /opt/spark

mv spark-1.6.3-bin-hadoop2.4-without-hive spark1.6-hadoop2.4-hive4.2.2,環境配置

編輯 /etc/profile 檔案

輸入:

export SPARK_HOME=/opt/spark/spark1.6-hadoop2.4-hive

export PATH=.:${JAVA_HOME}/bin:${SCALA_HOME}/bin:${SPARK_HOME}/bin:$PATH輸入:

source /etc/profile使配置生效

4.2.3,更改配置檔案

切換目錄

輸入:

cd /opt/spark/spark1.6-hadoop2.4-hive/conf4.2.3.1 修改 spark-env.sh

在conf目錄下,修改spark-env.sh檔案,如果沒有 spark-env.sh 該檔案,就複製spark-env.sh.template檔案並重命名為spark-env.sh。

修改這個新建的spark-env.sh檔案,加入配置:

export SCALA_HOME=/opt/scala/scala2.1

export JAVA_HOME=/opt/java/jdk1.8

export HADOOP_HOME=/opt/hadoop/hadoop2.8

export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

export SPARK_HOME=/opt/spark/spark1.6-hadoop2.4-hive

export SPARK_MASTER_IP=master

export SPARK_EXECUTOR_MEMORY=4G注:上面的路徑以自己的為準,SPARK_MASTER_IP為主機,SPARK_EXECUTOR_MEMORY為設定的執行記憶體。

4.2.3.2 修改slaves

slaves 分散式檔案

在conf目錄下,修改slaves檔案,如果沒有 slaves 該檔案,就複製slaves .template檔案並重命名為slaves 。

修改這個新建的slaves 檔案,加入配置:

slave1

slave2在一臺機器上(最好是master)做完這些配置之後,我們使用scp命令將這些配置傳輸到其他機器上。

輸入:

scala環境傳輸

scp -r /opt/scala root@slave1:/opt

scp -r /opt/scala root@slave2:/optspark環境傳輸

scp -r /opt/spark root@slave1:/opt

scp -r /opt/spark root@slave2:/opt傳輸之後,便在主節點啟動叢集。

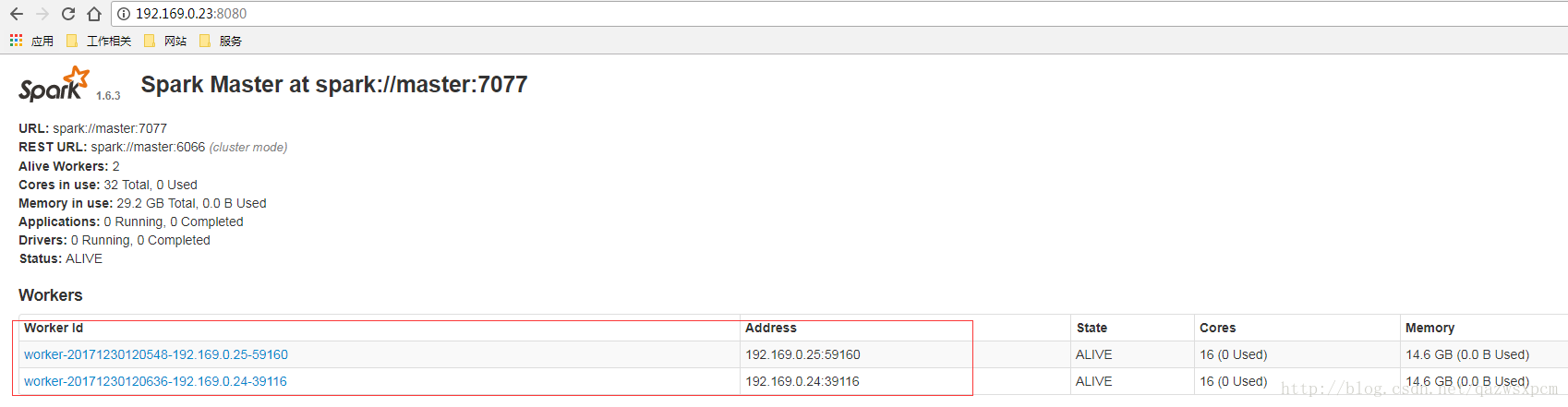

3,spark啟動

說明:要先啟動Hadoop

切換到Spark目錄下

輸入:

cd /opt/spark/spark2.2/sbin然後啟動Spark

輸入:

start-all.sh啟動成功之後,可以使用jps命令在各個機器上檢視是否成功。

可以在瀏覽器輸入: ip+8080 埠檢視

若成功顯示這個介面,則表示Spark成功啟動。

五、Zookeeper的環境配置

因為HBase做叢集,所以就需要zookeeper了。

zookeeper 在很多環境搭建上,都會有他的身影,如kafka、storm等,這裡就不多說了。

1,檔案準備

將下載下來的Zookeeper 的配置檔案進行解壓

在linux上輸入:

tar -xvf zookeeper-3.4.10.tar.gz然後移動到/opt/zookeeper裡面,沒有就新建,然後將資料夾重新命名為zookeeper3.4

輸入

mv zookeeper-3.4.10 /opt/zookeeper

mv zookeeper-3.4.10 zookeeper3.42,環境配置

編輯 /etc/profile 檔案

輸入:

export ZK_HOME=/opt/zookeeper/zookeeper3.4

export PATH=.:${JAVA_HOME}/bin:${SCALA_HOME}/bin:${SPARK_HOME}/bin:${ZK_HOME}/bin:$PATH輸入:

source /etc/profile使配置生效

3,修改配置檔案

5.3.1 建立檔案和目錄

在叢集的伺服器上都建立這些目錄

mkdir /opt/zookeeper/data

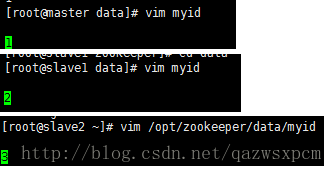

mkdir /opt/zookeeper/dataLog並且在/opt/zookeeper/data目錄下建立myid檔案

輸入:

touch myid建立成功之後,更改myid檔案。

我這邊為了方便,將master、slave1、slave2的myid檔案內容改為1,2,3

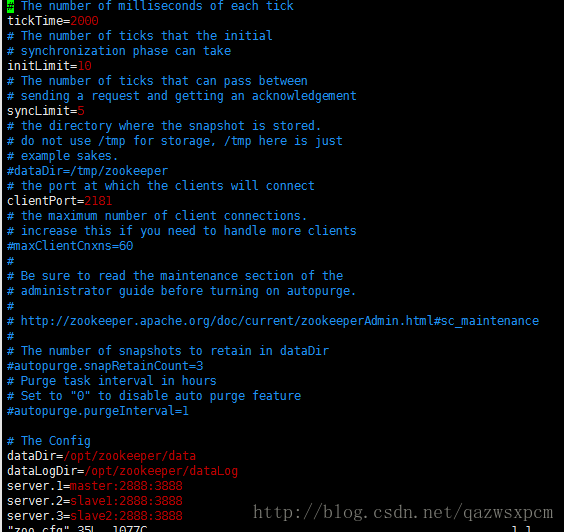

5.3.2 新建zoo.cfg

切換到/opt/zookeeper/zookeeper3.4/conf 目錄下

如果沒有 zoo.cfg 該檔案,就複製zoo_sample.cfg檔案並重命名為zoo.cfg。

修改這個新建的zoo.cfg檔案

dataDir=/opt/zookeeper/data

dataLogDir=/opt/zookeeper/dataLog

server.1=master:2888:3888

server.2=slave1:2888:3888

server.3=slave2:2888:3888說明:client port,顧名思義,就是客戶端連線zookeeper服務的埠。這是一個TCP port。dataLogDir裡是放到的順序日誌(WAL)。而dataDir裡放的是記憶體資料結構的snapshot,便於快速恢復。為了達到效能最大化,一般建議把dataDir和dataLogDir分到不同的磁碟上,這樣就可以充分利用磁碟順序寫的特性。dataDir和dataLogDir需要自己建立,目錄可以自己制定,對應即可。server.1中的這個1需要和master這個機器上的dataDir目錄中的myid檔案中的數值對應。server.2中的這個2需要和slave1這個機器上的dataDir目錄中的myid檔案中的數值對應。server.3中的這個3需要和slave2這個機器上的dataDir目錄中的myid檔案中的數值對應。當然,數值你可以隨便用,只要對應即可。2888和3888的埠號也可以隨便用,因為在不同機器上,用成一樣也無所謂。

1.tickTime:CS通訊心跳數

Zookeeper 伺服器之間或客戶端與伺服器之間維持心跳的時間間隔,也就是每個 tickTime 時間就會發送一個心跳。tickTime以毫秒為單位。

tickTime=2000

2.initLimit:LF初始通訊時限

叢集中的follower伺服器(F)與leader伺服器(L)之間初始連線時能容忍的最多心跳數(tickTime的數量)。

initLimit=10

3.syncLimit:LF同步通訊時限

叢集中的follower伺服器與leader伺服器之間請求和應答之間能容忍的最多心跳數(tickTime的數量)。

syncLimit=5

依舊將zookeeper傳輸到其他的機器上,記得更改 /opt/zookeeper/data 下的myid,這個不能一致。

輸入:

scp -r /opt/zookeeper root@slave1:/opt

scp -r /opt/zookeeper root@slave2:/opt4,啟動zookeeper

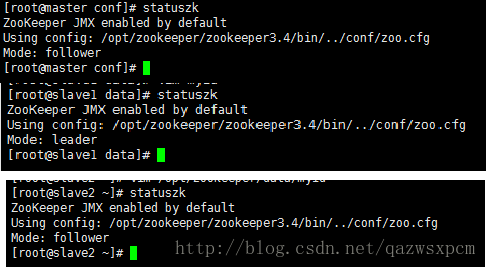

因為zookeeper是選舉制,它的主從關係並不是像hadoop那樣指定的,具體可以看官方的文件說明。

成功配置zookeeper之後,在每臺機器上啟動zookeeper。

切換到zookeeper目錄下

cd /opt/zookeeper/zookeeper3.4/bin輸入:

zkServer.sh start成功啟動之後

檢視狀態輸入:

zkServer.sh status可以檢視各個機器上zookeeper的leader和follower

六、HBase的環境配置

1,檔案準備

將下載下來的HBase的配置檔案進行解壓

在linux上輸入:

tar -xvf hbase-1.2.6-bin.tar.gz然後移動到/opt/hbase 資料夾裡面,並重命名為 hbase1.2

輸入

mv hbase-1.2.6 /opt/hbase

mv hbase1.2 /opt/hbase2,環境配置

編輯 /etc/profile 檔案

輸入:

export HBASE_HOME=/opt/hbase/hbase1.2

export PATH=.:${JAVA_HOME}/bin:${SCALA_HOME}/bin:${SPARK_HOME}/bin:$PATH輸入:

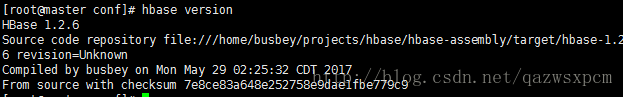

source /etc/profile使配置生效

輸入

hbase version

檢視版本

3,修改配置檔案

切換到 /opt/hbase/hbase-1.2.6/conf 下

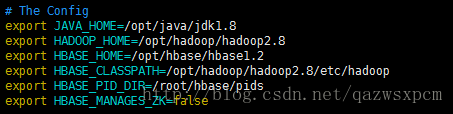

6.3.1 修改hbase-env.sh

編輯 hbase-env.sh 檔案,新增以下配置

export JAVA_HOME=/opt/java/jdk1.8

export HADOOP_HOME=/opt/hadoop/hadoop2.8

export HBASE_HOME=/opt/hbase/hbase1.2

export HBASE_CLASSPATH=/opt/hadoop/hadoop2.8/etc/hadoop

export HBASE_PID_DIR=/root/hbase/pids

export HBASE_MANAGES_ZK=false

說明:配置的路徑以自己的為準。HBASE_MANAGES_ZK=false 是不啟用HBase自帶的Zookeeper叢集。

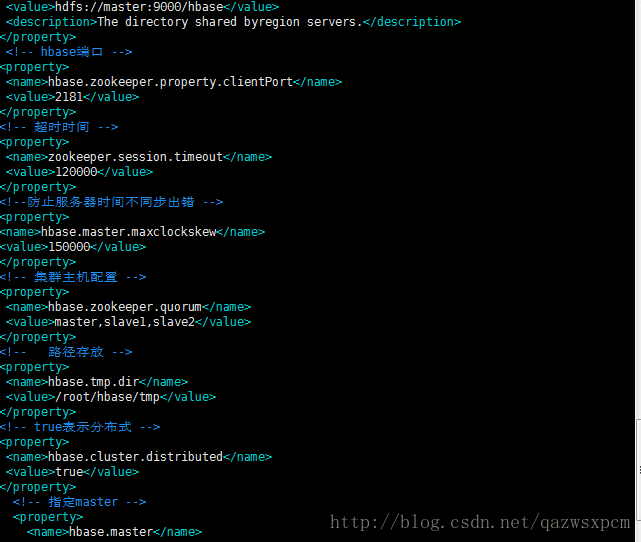

6.3.2 修改 hbase-site.xml

編輯hbase-site.xml 檔案,在<configuration>新增如下配置

<property>

<name>hbase.rootdir</name>

<value>hdfs://master:9000/hbase</value>

<description>The directory shared byregion servers.</description>

</property>

<!-- hbase埠 -->

<property>

<name>hbase.zookeeper.property.clientPort</name>

<value>2181</value>

</property>

<!-- 超時時間 -->

<property>

<name>zookeeper.session.timeout</name>

<value>120000</value>

</property>

<!--防止伺服器時間不同步出錯 -->

<property>

<name>hbase.master.maxclockskew</name>

<value>150000</value>

</property>

<!-- 叢集主機配置 -->

<property>

<name>hbase.zookeeper.quorum</name>

<value>master,slave1,slave2</value>

</property>

<!-- 路徑存放 -->

<property>

<name>hbase.tmp.dir</name>

<value>/root/hbase/tmp</value>

</property>

<!-- true表示分散式 -->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!-- 指定master -->

<property>

<name>hbase.master</name>

<value>master:60000</value>

</property>

</configuration>

說明:hbase.rootdir:這個目錄是region server的共享目錄,用來持久化Hbase 。hbase.cluster.distributed :Hbase的執行模式。false是單機模式,true是分散式模式。若為false,Hbase和Zookeeper會執行在同一個JVM裡面。

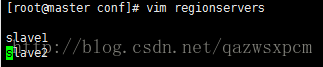

6.3.3 修改regionservers

指定hbase的主從,和hadoop的slaves檔案配置一樣

將檔案修改為

slave1

slave2

注:上面的為叢集的主機名稱

在一臺機器上(最好是master)做完這些配置之後,我們使用scp命令將這些配置傳輸到其他機器上。

輸入:

hbase環境傳輸

scp -r /opt/hbaseroot@slave1:/opt

scp -r /opt/hbase root@slave2:/opt傳輸之後,便在主節點啟動叢集。

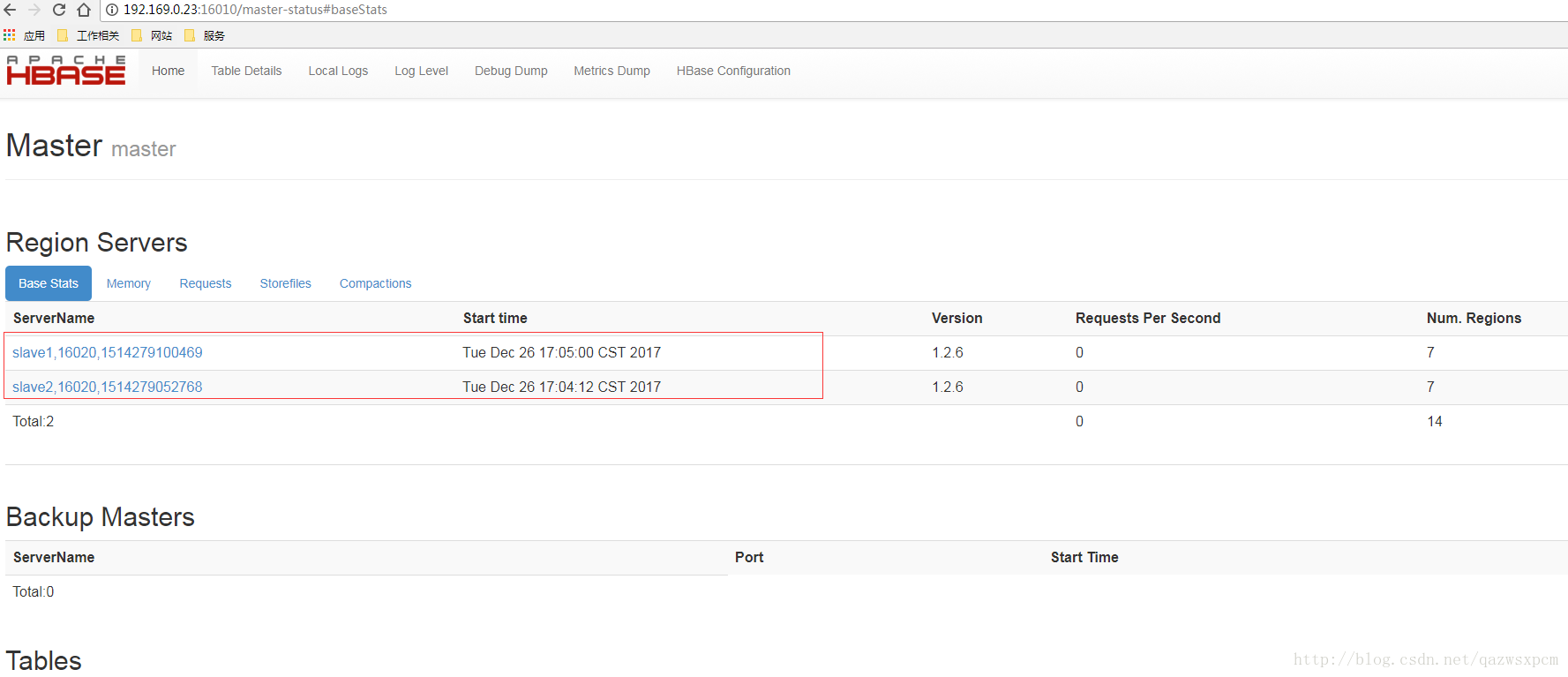

4,啟動hbase

在成功啟動Hadoop、zookeeper之後

切換到HBase目錄下

cd /opt/hbase/hbase1.2/bin輸入:

start-hbase.sh啟動成功之後,可以使用jps命令在各個機器上檢視是否成功

可以在瀏覽器輸入: ip+16010 埠檢視

若成功顯示該介面,則啟動成功。

七、Hive的環境安裝配置

八、其他

到此,本教程就結束了,謝謝閱讀!