Android流媒體開發之路一:Camera2採集攝像頭原始資料並手動預覽

Android Camera2採集攝像頭原始資料並手動預覽

最近研究了一下android攝像頭開發相關的技術,也看了Google提供的Camera2Basic呼叫示例,以及網上一部分程式碼,但都是在TextureView等預覽基礎上實現,而我想要做的是在不預覽的情況下,能獲取到攝像頭原始資料流,並由自己來決定是否繪製顯示。經過一番折騰,初步實現了自己的目的——CamCap程式。

需求分析

其實主要就是在不預覽的情況下獲取到攝像頭原始資料,目的嘛,一是為了靈活性,方便隨時開啟關閉預覽,二是為了以後可以直接對資料進行處理,三是為了其他程式開發做一些準備。於是實現一下幾個功能:

- 獲取攝像頭資料,並手動繪製圖像

- 隨時開啟/關閉預覽

- 隨時儲存當前攝像頭影象,即使在關閉預覽情況下

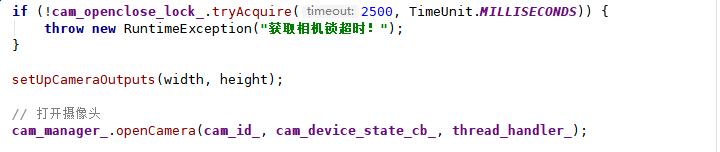

Android Camera2介面

查閱了一些資料,Android Java層由於從API21開始,已經廢棄原Camera介面,所以這裡採用Camera2介面。相比Camera介面來說,第二代攝像頭介面,呼叫複雜多了,但是靈活性也更高了,通過Google的Camera2Basic例子可以很清楚的瞭解到使用方式。這裡把CamCap程式中的Camera2的呼叫順序整理如下:

和其他程式一樣,通過ImageReader來獲取到CameraCaptureSession傳遞出來的資料,與Google例子不同的是,我取消了把TextureView的傳遞,改為單獨以ImageReader來獲取影象流,並設定為YUV_420_888格式,以拿到原始資料。

開啟攝像頭

攝像頭開啟後,建立對話

呼叫libyuv做RGB之間的資料轉換

獲取到YUV資料之後,就可以在UI介面上進行繪製了,通過簡單瞭解,可以通過OpenGLES來繪製,也可以轉為Bitmap直接在TextureView上繪製。這裡為了簡單,選擇了後者。然而後來發現,android.graphics.Bitmap並不支援直接將YUV資料存入,只能轉為RGB資料格式,才能存入Bitmap,進而在TextureView上繪製。YUV轉換RGB,之前在C++上應用過很多次了,可以把現有程式碼修改一下放到java裡執行,不過考慮到效能問題,決定還是使用libyuv。libyuv是一款以c/c++為基礎的,專做YUV與RGB格式轉換的開源專案,效能非常高。

使用libyuv,需要通過NDK交叉編譯,並通過JNI來呼叫。libyuv編譯起來也很簡單,首先下載libyuv原始碼,程式碼地址是:https://chromium.googlesource.com/libyuv/libyuv 。然後確保NDK已經安裝(這個直接在AndroidStudio中就能安裝好),之後把NDK目錄新增到環境變數。最後,進入libyuv目錄,呼叫ndk-build即可。libyuv專案裡已經寫好了Android.mk,所以,直接編譯就行了(我是在Windows上)。

注意!編譯的時候遇到JPEG庫沒有指定的問題,如果不想依賴libjpeg,可以修改Android.mk,刪除JPEG庫相關編譯項就可以解決。

在AndroidStudio上建立c++檔案,封裝libyuv介面,然後按照JNI規範暴露介面,同時在Java層封裝類來呼叫native方法。

繪製圖像

在繪製圖像的時候,有個坑,那就是影象的旋轉,這個是由於手機上的攝像頭感測器的視野座標,一般都是旋轉了90度或270度的,所以,需要把攝像頭採集到的畫面,進行旋轉,才能還原出正確的視野畫面。感測器旋轉方向通過以下值獲得,

CameraManager.getCameraCharacteristics(camid).get(CameraCharacteristics.SENSOR_ORIENTATION)

根據這個值,構建Matrix將Bitmap進行旋轉

Matrix構建程式碼如下:

與上面程式碼中類似,通過TextureView.lockCanvas(),獲取到Canvas,呼叫drawBitmap()將影象寫入,即可完成繪製。

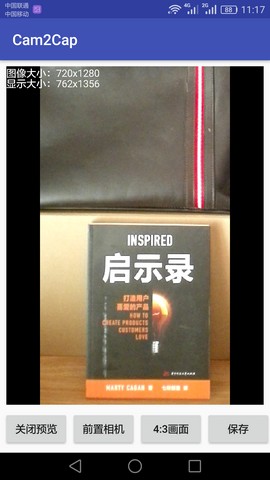

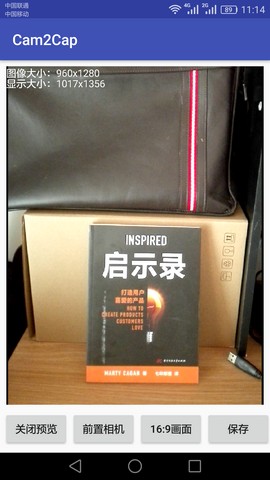

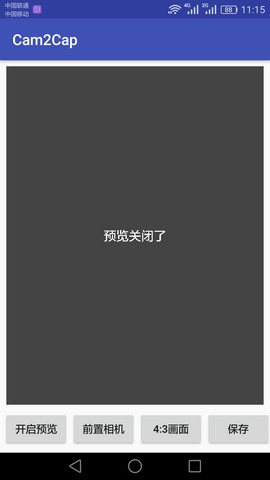

執行截圖

開啟預覽時的4:3畫面和16:9畫面

關閉預覽,同時可以繼續拍照

+++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++

合作請聯絡QQ。(轉載請註明作者和出處~)

合作請聯絡QQ。(轉載請註明作者和出處~)

+++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++