GBDT梯度提升樹(一)

提升樹(例項)

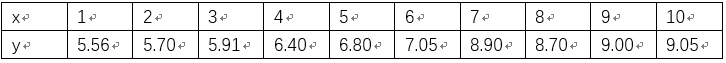

已知訓練資料如上表所示,x的取值範圍為區間[0.5,10.5],y的取值範圍為區間[5.0,10.0],學習這個迴歸問題的提升樹模型,考慮只用樹樁作為基函式。

解

提升樹(例項)

已知訓練資料如上表所示,x的取值範圍為區間[0.5,10.5],y的取值範圍為區間[5.0,10.0],學習這個迴歸問題的提升樹模型,考慮只用樹樁作為基函式。

解 既然是一個提升樹,

GBDT是整合學習方法Boosting中的一種,所以其中每個弱分類器都有先後順序,同時每個弱分類器都有其的權重。

GBDT的思想 在GBDT的迭代過程中,假如前一輪迭代得到的強分類器是

Fm−1(x)

F

機器學習筆記10-梯度提升樹(GBDT)

在上一節中講到了整合學習的Boosting方法,並詳細解釋了其中的代表性演算法AdaBoost演算法。除了AdaBoost演算法外,Boosting中還有另一個非常常用的演算法:提升樹和梯度提升樹(GBDT)。

提升樹 提升樹是以分

首先我們回顧一下Gradient Boosting 的本質,就是訓練出,使損失函式最小,即

其求解步驟如下:

所以,我們首先得定義出損失函式,才能談求解的事情。接下來我們針對不同場景,介紹相應的損失函式。

迴歸

對於迴歸問題,定義好損失函式後,Gradient B

(1)描述

梯度提升樹(GBT)是決策樹的集合。 GBT迭代地訓練決策樹以便使損失函式最小化。 spark.ml實現支援GBT用於二進位制分類和迴歸,可以使用連續和分類特徵。

(2)測試資料

1 153:5 154:63 155:197 181:20 182:254 183:230 1

(1)描述

梯度提升樹(GBT)是決策樹的集合。 GBT迭代地訓練決策樹以便使損失函式最小化。 spark.ml實現支援GBT用於二進位制分類和迴歸,可以使用連續和分類特徵。

(2)測試資料

1 153:5 154:63 155:197 181:20 182:254 183:230 1

機器學習 - 提升樹(下)- XGBoost 以及與 GBDT 的比較

XGBoost(eXtreme Gradient Boost)

原理

預剪枝

與 GBDT 的比較

機器學習 - 提升樹(上)- BT、GBDT

BT(Boosting Tree)

介紹

原理

演算法過程

舉例

GBDT(Gradient Boosting De cte 求解 分支 基本概念 tracking 它的 解決 mat 這就是

決策樹(decision tree)是一種基本的分類與回歸方法。其表示的樹型結構,能夠覺得是if-else規則的集合。基本的長處是分類可讀性好,速度快。一般會有三個步驟:特征選擇、決策樹的生成 reorder system style 序列 urn creat 編寫程序 space ont

設計和編寫程序,按照輸入的遍歷要求(即先序、中序和後序)完成對二叉樹的遍歷,並輸出相應遍歷條件下的樹結點序列。

1 //遞歸實現

2 #include 判斷 right 不為 exist avl 輸入 位置 bubuko get 二叉搜索樹(Binary Search Tree),簡稱BST,顧名思義,一顆可以用於搜索的二叉樹。BST在數據結構中占有很重要的地位,一些高級樹結構都是其的變種,例如AVL樹、紅黑樹等,因此

1、舉例:

關於什麼是決策樹(decision tree),我們先來看這麼一個例子。假如我錯過了看世界盃,賽後我問一個知道比賽結果的人“哪支球隊是冠軍”?他不願意直接告訴我,而讓我猜,並且每猜一次,他要收一元錢才肯告訴我是否猜對了,那麼我要掏多少錢才能知道誰是冠軍呢?我可以把球隊編上號,從1到1

# -*- coding: utf-8 -*-

"""

熵定義為資訊的期望值。

熵:表示隨機變數的不確定性。

條件熵:在一個條件下,隨機變數的不確定性。

資訊增益:熵 - 條件熵

在一個條件下,資訊不確定性減少的程度!

如果選擇一個特徵後,資訊增益最大(資訊不確定性減少的程度最大),那麼我們就選取這 1、GBDT(梯度提升樹)概述:

GBDT是整合學習Boosting家族的成員,區別於Adaboosting。adaboosting是利用前一次迭代弱學習器的誤差率來更新訓練集的權重,在對更新權重後的訓練集繼續迭代訓練。GBDT也是迭代演算法,但是不同於Adaboosting,GBDT是進行一

決策樹是一種通過推斷分解,逐步縮小待推測事物範圍的演算法結構,重要任務就是理解資料中所蘊含的知識資訊,可以使用不熟悉的資料集合,並從中提取出一系列規則,根據資料集建立規則的過程就是機器學習的過程。

優點:計算複雜度不高,輸出結果易於理解,對中間值的缺失不敏感,可以處理不相關特

一、二叉樹問題概述

二叉樹型別的題目為常考題型

原因:

能夠結合佇列、棧、連結串列、字串等多資料結構

需要掌握圖的基本遍歷方法,比如BFS和DFS

需要掌握遞迴函式的使用,並自己設計出遞迴過程

二叉樹問題與實際工作結合緊密

二、二叉樹先序

二叉樹的基本概念

什麼是二叉樹

一棵二叉樹是結點的一個有限集合,該集合或者為空,或者是由一個根節點加上兩棵分別稱為左子樹和右子樹的二叉樹組成

特點

每個結點最多有兩棵子樹,即二叉樹不存在度大於2的結點

二叉樹的子樹有左右之分,其子樹的次序不能顛倒

兩種特殊

from math import log

#計算給定的熵

def calcsahnnonent(dataset):

numentries = len(dataset) #計算例項的總數

labelcounts ={}

#

104.二叉樹的最大深度

解題思路:

採用遞迴來做,首先判斷root是否為NULL,然後比較左右數的最大深度,較大的一個+1即可。

int maxDepth(TreeNode* root) {

if(root== NULL)

1, 二叉搜尋樹中的是否存在二個數的和為某個數(653)

思路:藉助外部空間,判斷是否有二個數的和為固定的值,避免一直遞迴來求解。再最後求得那個地方,因為採用中序遍歷,所以就是順序排列,在搜尋二個數和為某個值的情況,可以進行一部分優化。

class Solution(object):

既然是一個提升樹,

fM(x)=∑m=1MT(x;θm),那麼第一步需要求

f1(x),即迴歸樹

T1(x),首先通過以下優化問題,

smin[e1minxi∈R1∑(yi−c1)2+e2minxi∈R2∑(yi−c2)2]

然後求解訓練資料的的切分點S,

R1={x∣x≤s},R2={x∣x>s},容易求得在

R1和

R2內部使平方損失誤差達到最小值的

c1和

c2,分別為

c1=N11∑xi∈R1yi,

c2=N21∑xi∈R2yi,這裡

N1,

N2是樣本個數。

m(s)=e1minxi∈R1∑(yi−c1)2+e2minxi∈R2∑(yi−c2)2

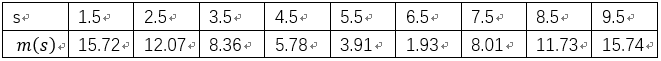

將上面的想法應用到資料上,考慮切分點:1.5,2.5,3.5,4.5,5.5,6.5,7.5,8.5,9.5。

當s=1.5,

R1={1},

R2={2,3,4,5,6,7,8,9,10},

c1=5.56,

c2=7.50, m(s)=0+15.72=15.72;將s和m(s) 計算結果記錄。

由上表可知,當s=6.5時, m(s)達到最小值,此時

R

相關推薦

GBDT梯度提升樹(一)

梯度提升樹(GBDT)理解

機器學習筆記10-梯度提升樹(GBDT)

GBDT梯度提升樹演算法原理小結(三)

Spark-MLlib的快速使用之五(梯度提升樹GBT 迴歸)

Spark-MLlib的快速使用之四(梯度提升樹GBT 分類)

機器學習 - 提升樹(下)- XGBoost 以及與 GBDT 的比較

機器學習 - 提升樹(上)- BT、GBDT

監督式學習 -- 分類決策樹(一)

數據結構之二叉樹(一)

數據結構 - 從二叉搜索樹說到AVL樹(一)之二叉搜索樹的操作與詳解(Java)

決策樹(一)

決策樹 (一)

GBDT(梯度提升樹)scikit-klearn中的引數說明及簡匯

機器學習實戰--決策樹(一)

【面試演算法】——二叉樹(一)

二叉樹(一)

機器學習實戰決策樹(一)——資訊增益與劃分資料集

LeetCode——樹(一)

leetcode題目:樹(一)