大資料Hadoop學習筆記(二)

阿新 • • 發佈:2018-11-09

Single Node Setup

1. 本地模式

2.偽分散式模式

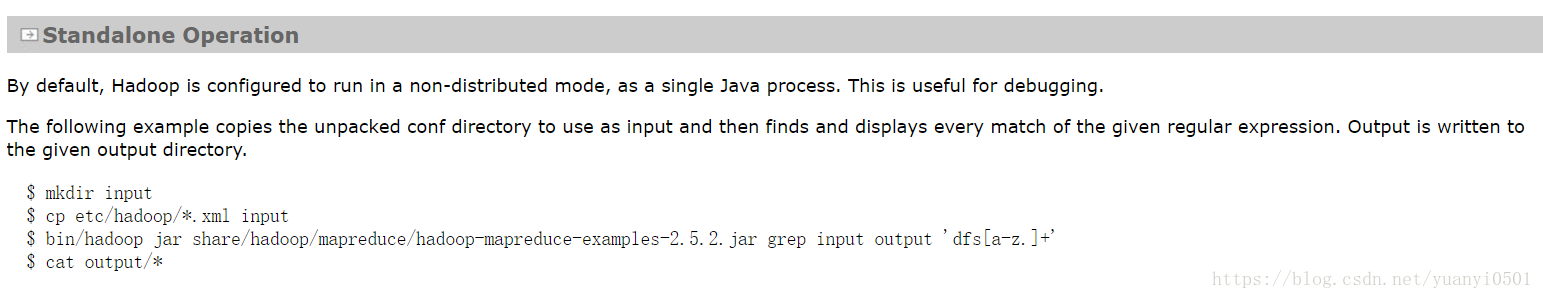

************************* 本地模式 ****************************

- . grep input output ‘dfs[a-z.]+’ 執行mapreduce的例子,input是當前目錄下的資料夾;output是執行輸出結果儲存的地方,並且在當前目錄下沒有。'dfs[a-z.]+'是檢索的引數

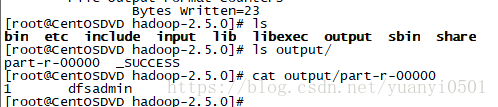

可以看到執行成功後,目錄中出現了output。output中有_success檔案說明成功。運算結果在part-r-00000中,結果如圖2-2所示。 - bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.5.0.jar wordcount wcinput wcoutput

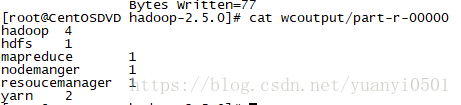

檢視wcinput中wc.input檔案中單詞的數量,執行結果如下:

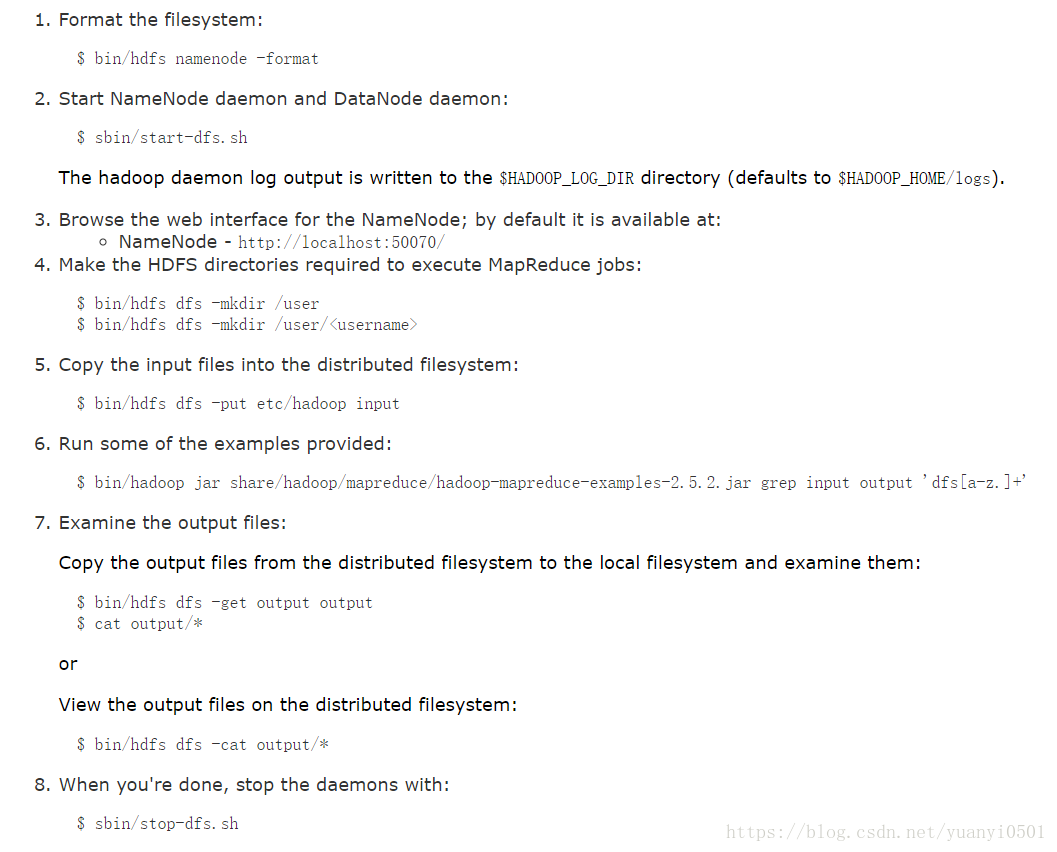

*********************** 偽分散式******************************

- hadoop的埠號一般為8020

- namenode儲存的元資料

- $ bin/hdfs namenode -format namenode格式化

- sbin/hadoop-daemon.sh start namenode 啟動namenode

- sbin/hadoop-daemon.sh start datanode 啟動datanode。

- 在根目錄下會出現log資料夾,說明啟動成功

- 訪問192.168.220.128:50070

- 具體步驟:

-

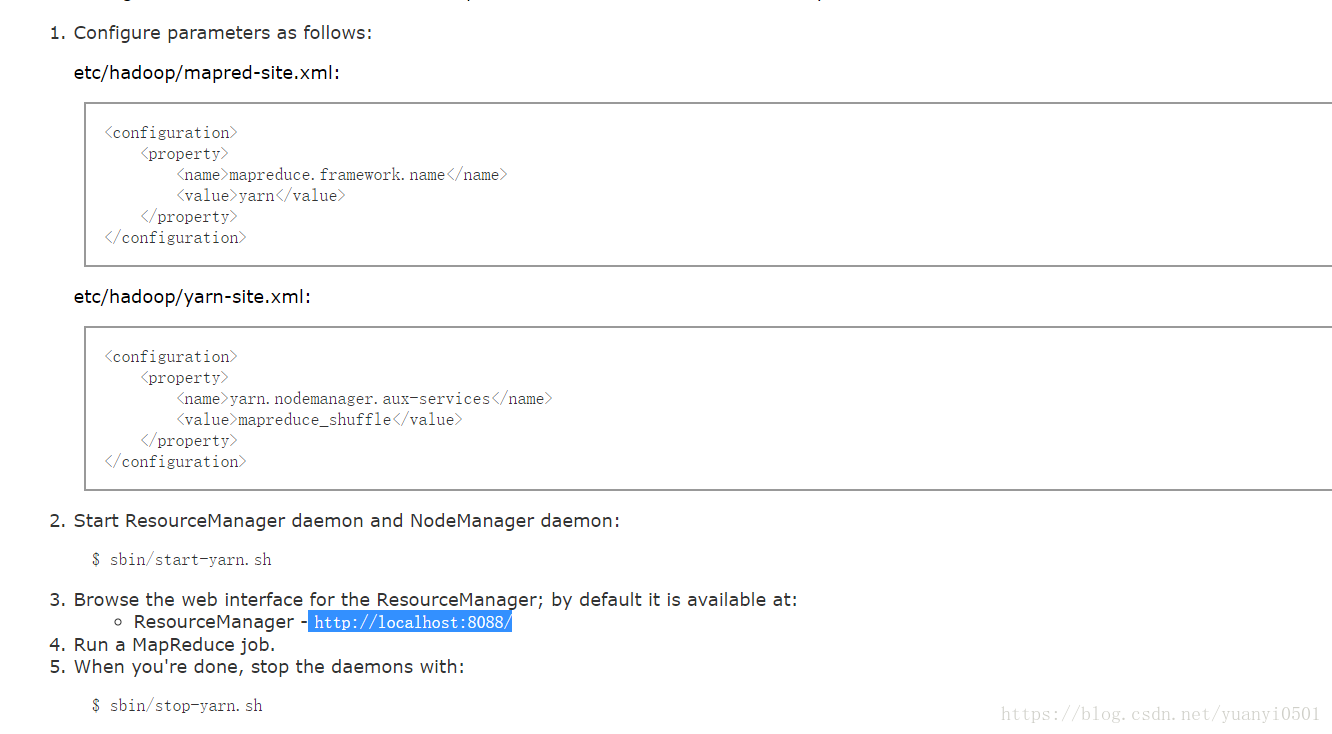

YARN on Single Node

- 步驟如下:

啟動方式

- 服務逐一啟動

hdfs:sbin/hadoop-daemon.sh start|stop namenode|datanode|secondarynamenode

yarn:sbin/yarn-daemon.sh start|stop resourcemanager|nodemanager

mapreduce: sbin/mr-historyserver-daemon.sh start|stop history - 各個模組啟動:(配置ssh無金鑰登陸)

hdfs:sbin/start-dfs.sh

yarn:sbin/start-yarn.sh - 一起啟動:

sbin/start-all.sh

配置檔案

HDFS

- NameNode:core-site.xml檔案

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>———》指定了namenode執行的機器hostname:8020

</property>

-

DataNode:slaves檔案

-

SecondaryNamenode:hdfs-site.xml

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>"hostname":50090</value>————》指定了namenode執行的機器

</property>

YARN

- ResourceManager:yarn-site.xml

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hsotname</value>

</property>

-

NodeManager:slaves檔案

-

MapReduce:mapred-site.xml

-

HistoryServer:mapred-site.xml

<property>

<name>mapreduce.jobhistory.address</name>

<value>hsotname:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hsotname:19888</value>

</property>