Python實現簡單爬蟲功能--批量下載百度貼吧裡的圖片

阿新 • • 發佈:2018-11-04

在上網瀏覽網頁的時候,經常會看到一些好看的圖片,我們就希望把這些圖片儲存下載,或者使用者用來做桌面桌布,或者用來做設計的素材。

我們最常規的做法就是通過滑鼠右鍵,選擇另存為。但有些圖片滑鼠右鍵的時候並沒有另存為選項,還有辦法就通過就是通過截圖工具擷取下來,但這樣就降低圖片的清晰度。如何批量的儲存圖片呢,Python幾行程式碼就能搞定。

獲取頁面資料

到http://tieba.baidu.com/p/2460150866 去檢視

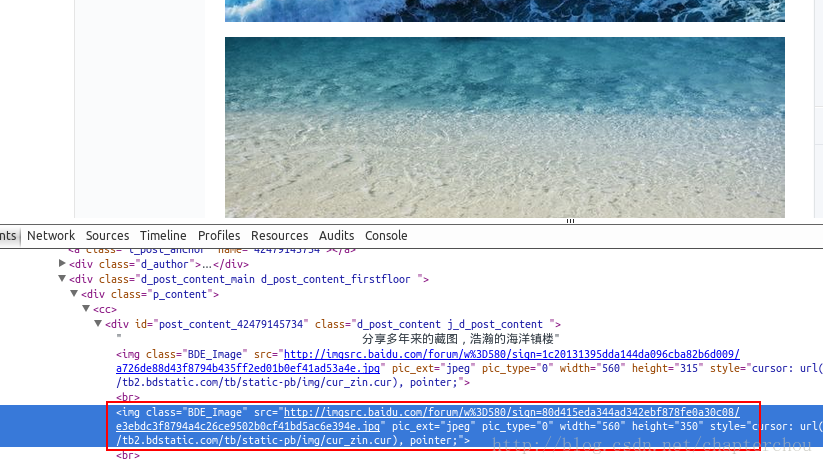

通過到前段檢視工具。找到了圖片的地址,如:src=”http://imgsrc.baidu.com/forum……jpg”pic_ext=”jpeg”

程式碼

# coding=utf-8

import urllib.request

import re

def downloadPage(url):

h = urllib.request.urlopen(url)

return h.read().decode('utf-8')

def downloadImg(content):

pattern = r'src="(.+?\.jpg)" pic_ext'

m = re.compile(pattern)

urls = re.findall(m, content)

for i, url in